모션 캡처

Motion capture

모션 캡처(mo-cap 또는 mocap이라고도 함)는 물체 또는 사람의 움직임을 기록하는 프로세스입니다.군사, 엔터테인먼트, 스포츠, 의료 애플리케이션 및 컴퓨터[3] 비전 및 [4]로봇 검증에 사용됩니다.영화 제작 및 비디오 게임 개발에서, 그것은 인간 배우들의 행동을 기록하고, 그 정보를 사용하여 2-D 또는 3-D 컴퓨터 [5][6][7]애니메이션으로 디지털 캐릭터 모델을 애니메이션화하는 것을 말한다.얼굴과 손가락을 포함하거나 미묘한 표정을 캡처하는 경우 성능 [8]캡처라고 합니다.많은 분야에서 모션 캡처를 모션 트래킹이라고 부르기도 하지만, 영화 제작 및 게임에서는 모션 트래킹이 일반적으로 매치 무빙을 더 많이 나타냅니다.

모션 캡처 세션에서는 1명 이상의 배우의 움직임이 초당 여러 번 샘플링된다.초기 기법은 여러 카메라의 이미지를 사용하여 3D [9]위치를 계산하는 반면, 모션 캡처의 목적은 종종 배우의 시각적 외모가 아닌 움직임만 기록하는 것입니다.이 애니메이션 데이터는 모델이 배우와 동일한 작업을 수행하도록 3D 모델에 매핑됩니다.이 과정은 이전의 로토스코프 기법과 대조될 수 있습니다.

또한 연기자가 연기를 하는 동안 장면에 있는 가상 카메라가 카메라 오퍼레이터에 의해 구동되는 스테이지를 회전하거나 기울이거나 돌리기 위해 카메라의 움직임을 캡처할 수 있습니다.동시에 모션 캡처 시스템은 배우의 연기뿐만 아니라 카메라와 소품도 캡처할 수 있다.이것에 의해, 컴퓨터로 생성된 문자, 화상, 세트가 카메라의 비디오 영상과 같은 시점을 가질 수 있습니다.컴퓨터는 데이터를 처리하여 액터의 움직임을 표시함으로써 세트 내의 오브젝트 측면에서 원하는 카메라 위치를 제공한다.캡처한 영상에서 카메라 이동 데이터를 소급하여 얻는 것을 성냥 이동 또는 카메라 추적이라고 합니다.

모션 캡처를 통해 애니메이션화된 최초의 가상 배우는 1993년 그리부유에 있는 디디에 포르셀과 그의 팀에 의해 제작되었다.그것은 프랑스 코미디언 리차드 보링거의 몸과 얼굴을 "복제"한 다음, 여전히 냄새를 풍기는 모션 캡처 도구로 애니메이션을 만드는 것을 포함했다.

이점

모션 캡처는 3D 모델의 기존 컴퓨터 애니메이션에 비해 다음과 같은 몇 가지 이점을 제공합니다.

- 실시간에 가까운 짧은 지연 시간을 얻을 수 있습니다.엔터테인먼트 애플리케이션에서는 이를 통해 키프레임 기반 [10]애니메이션 비용을 절감할 수 있습니다.Hand Over 기법이 그 예입니다.

- 작업량은 기존 기법을 사용할 때와 같은 정도로 공연의 복잡성이나 길이에 따라 달라지지 않습니다.이것은 배우의 재능에 의해서만 제한되는 다른 개성을 주면서, 다양한 스타일이나 전달로 많은 테스트를 할 수 있게 한다.

- 복잡한 움직임과 2차 움직임, 무게, 힘의 교환과 같은 사실적인 물리적 상호작용을 물리적으로 정확한 [11]방법으로 쉽게 재현할 수 있습니다.

- 기존 애니메이션 기법에 비해 주어진 시간 내에 제작할 수 있는 애니메이션 데이터의 양은 매우 크다.이는 비용 효율과 생산 기한 [12]준수에 모두 기여합니다.

- 무료 소프트웨어 및 서드파티 솔루션을 통해 비용을 절감할 수 있습니다.

단점들

- 데이터를 입수하여 처리하려면 특정 하드웨어 및 특수 소프트웨어 프로그램이 필요합니다.

- 소규모 프로덕션에서는 필요한 소프트웨어, 장비 및 인력의 비용이 만만치 않을 수 있습니다.

- 캡처 시스템은 카메라 시야 또는 자기 왜곡에 따라 작동 공간에 대한 특정 요구 사항이 있을 수 있습니다.

- 문제가 발생하면 데이터를 조작하는 것보다 장면을 다시 촬영하는 것이 더 쉽습니다.데이터를 실시간으로 볼 수 있는 시스템은 극히 일부입니다.

- 초기 결과는 데이터를 추가로 편집하지 않고도 캡처 볼륨 내에서 수행할 수 있는 작업으로 제한됩니다.

- 물리 법칙을 따르지 않는 움직임은 포착될 수 없습니다.

- 스쿼시 및 스트레치 애니메이션 기법과 같이 기대와 팔로우, 보조 동작 또는 캐릭터의 형상 조작을 강조하는 전통적인 애니메이션 기법은 나중에 추가되어야 한다.

- 컴퓨터 모델의 비율이 캡처 대상과 다른 경우 아티팩트가 발생할 수 있습니다.예를 들어, 만화 캐릭터의 손이 크고 크다면, 인간 연기자가 자신의 신체적인 움직임을 조심하지 않는다면, 그것들은 캐릭터의 몸과 교차할 수 있다.

적용들

비디오 게임은 종종 모션 캡처를 사용하여 운동선수, 무술가, 그리고 다른 게임 [13][14]속 캐릭터들을 애니메이션으로 만듭니다.1988년, 초기 형태의 모션 캡쳐는 마르텍의 비디오 게임 Vixen(모델 Corinne [15]Russell이 연기)과 Magic Company의 2D 아케이드 격투 게임 Last Aradio Puppet Show(디지털화된 [16]스프라이트를 애니메이션화하기 위해)의 2D 플레이어 캐릭터를 애니메이션화하는 데 사용되었습니다.모션 캡처는 나중에 세가 모델 아케이드 게임인 Virtua Fighter(1993년)[17][18]와 Virtua Fighter 2(1994년)[19]에서 3D 캐릭터 모델을 애니메이션화하는 데 사용되었습니다.1995년 중반 개발자/출판사 Aclight Entertainment는 자체 모션 캡처 스튜디오를 [14]본사에 내장했습니다.남코의 1995년 아케이드 게임 쏘울 엣지는 모션 [20]캡처를 위해 패시브 광학 시스템 마커를 사용했다.

영화는 CG 효과, 경우에 따라서는 전통적인 셀 애니메이션을 대체하기 위해 모션 캡처를 사용하고 골룸, 미라, 킹콩, 캐리비안의 해적, 영화 아바타의 나비, 트론: 레거시의 클루와 같은 완전한 컴퓨터 생성 생물들을 위해 모션 캡처를 사용합니다.2012년 영화 호빗의 많은 오크들과 도깨비들: 뜻밖의 여행과 스마우는 모션 캡처를 사용하여 만들어졌다.

영화 배트맨 포에버는 특정한 특수 효과를 위해 모션 캡처를 사용했다.워너 브라더스는 영화 [21]제작에 사용하기 위해 아케이드 비디오 게임 회사인 Aclight Entertainment로부터 모션 캡처 기술을 인수했다.1995년에 발매된 Aclight의 동명의 비디오 게임도, 디지털화된 스프라이트 [22]그래픽을 애니메이션 하기 위해서 같은 모션 캡쳐 기술을 사용했습니다.

스타워즈: 에피소드 I – 팬텀 위협 (1999년)은 모션 캡처를 사용하여 만들어진 주인공(아메드 베스트가 연기한 자르 빙크스)과 인도계 미국인 영화 신바드를 포함한 최초의 장편 영화이다. 비록 많은 캐릭터 애니메이션 제작자들이 매우 제한된 개봉을 한 이 영화에 작업했지만, 안개의 베일을 넘어 (2000년)는 모션 캡처를 주로 한 장편 영화였다.2001년 파이널 판타지: Spirits Within은 모션 캡쳐 기술을 주력으로 제작된 최초의 널리 개봉된 영화였다.흥행은 저조했지만 모션 캡처 기술 지지자들은 주목했다.Total Recall(전체 리콜)은 이미 X선 스캐너와 해골 장면에서 이 기술을 사용했습니다.

반지의 제왕: Two Towers는 실시간 모션 캡처 시스템을 이용한 최초의 장편 영화이다.이 방법은 배우 Andy Serkis의 동작을 컴퓨터 생성 Gollum/Smeagol의 피부로 스트리밍했습니다.[23]

2006년 아카데미 장편 애니메이션상 후보 3명 중 2명(몬스터 하우스와 수상자 해피 피트)이 모션 캡처를 사용했고, 모션 캡처를 사용하지 않고 애니메이션화된 것은 디즈니 픽사 자동차뿐이었다.픽사의 영화 '라따뚜이'의 엔딩 크레딧에는 "100% 순수 애니메이션 – No Motion Capture!"라는 라벨이 붙어 있습니다.

2001년 이후 모션 캡처는 거의 사실적인 디지털 캐릭터 모델을 사용하여 실제 영화관의 외관을 시뮬레이션하거나 근사하기 위해 광범위하게 사용되고 있습니다.폴라 익스프레스는 톰 행크스가 여러 개의 뚜렷한 디지털 캐릭터로 연기할 수 있도록 하기 위해 모션 캡처를 사용했다.2007년 베오울프의 각색에서는 디지털 캐릭터의 외모가 부분적으로 그들의 동작과 목소리를 제공하는 배우들을 기반으로 한 애니메이션화 되었다.제임스 카메론의 매우 인기 있는 아바타는 판도라에 사는 나비족을 만들기 위해 이 기술을 사용했습니다.월트 디즈니사는 이 기법을 사용하여 로버트 제멕키스의 크리스마스 캐롤을 제작했습니다.2007년 디즈니는 제메키스의 ImageMovers Digital(모션 캡처 영화 제작사)을 인수했지만 Mars Needs Moms의 흥행 실패로 2011년 문을 닫았다.

모션 캡쳐 애니메이션으로 제작된 TV 시리즈는 캐나다의 라플라크, 네덜란드의 스루크제스붐과 카페 [nl] 드 와렐드, 영국의 헤드케이스를 포함한다.

uSens, Gestigon과 같은 가상현실 및 증강현실 제공자는 사용자가 손동작을 캡처하여 디지털 콘텐츠와 실시간으로 상호작용할 수 있도록 합니다.이는 3D 환경에서 시뮬레이션, 시각적 지각 테스트 또는 가상 워크스루 수행에 유용할 수 있습니다.모션 캡처 기술은 컴퓨터가 생성한 캐릭터를 실시간으로 구동하기 위해 디지털 인형 시스템에서 자주 사용됩니다.

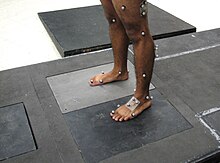

보행 분석은 임상 의학에서 모션 캡처의 한 응용 프로그램입니다.기법은 임상의가 여러 생체역학적 요소에 걸쳐 인간의 움직임을 평가할 수 있도록 하며, 종종 이 정보를 분석 소프트웨어로 실시간으로 스트리밍할 수 있도록 한다.

일부 물리치료 클리닉에서는 모션 캡처를 환자의 [24]진행 상황을 정량화하는 객관적인 방법으로 사용합니다.

James Cameron의 Avatar를 촬영하는 동안, 이 과정에 관련된 모든 장면은 오토데스크 MotionBuilder 소프트웨어를 사용하여 실시간으로 연출되었습니다. 이를 통해 감독과 배우는 그들이 영화에서 어떻게 보일지 볼 수 있게 되어, 보는 사람이 보는 것처럼 영화를 연출하기가 더 쉬워졌습니다.이 방법에서는 렌더링 전 애니메이션에서는 뷰와 각도를 사용할 수 없습니다.카메론은 그의 결과에 매우 자랑스러워하여 스티븐 스필버그와 조지 루카스를 촬영장에 초대하여 이 시스템을 실제로 보게 하였다.

마블의 '어벤져스'에서 마크 러팔로는 이전 영화들처럼 CGI가 아닌 헐크를 연기할 수 있도록 모션 캡처를 사용했고, 루팔로는 인간과 헐크 버전의 브루스 배너를 모두 연기한 최초의 배우가 되었다.

FaceRig 소프트웨어는 ULSee의 얼굴 인식 기술을 사용합니다.플레이어의 표정과 인지 뉴런의 신체 추적 기술을 매핑하여 3D 또는 2D 캐릭터의 [25][26]움직임을 화면에 매핑합니다.

샌프란시스코 Epic Games에서 열린 Game Developers Conference 2016에서 Unreal Engine에서 전신 모션 캡처를 시연했습니다.세누아라는 이름의 여전사에 대한 다가오는 게임 헬블레이드의 모든 장면이 실시간으로 그려졌다.기조 강연은[27] 언리얼 엔진, 닌자 이론, 3Lateral, 큐빅 모션, IKinema, Xsens의 콜라보레이션이었습니다.

라마야나를 원작으로 한 인도 영화 아디푸루시.이 영화는 할리우드가 아디푸루쉬의 세계에 생명을 불어넣기 위해 사용하는 엑스센스 모션 캡처와 얼굴 캡처와 같은 고급 실시간 기술을 사용한 매그넘 오퍼스로 알려져 있다.Adipurush는 램 경의 이야기이다.

방법 및 시스템

모션 트래킹 또는 모션 캡처는 1970년대와 1980년대 생체역학 연구의 사진 측량 분석 도구로 시작되었으며, 기술이 발달함에 따라 교육, 훈련, 스포츠 및 최근에는 텔레비전, 영화, 비디오 게임용 컴퓨터 애니메이션으로 확장되었습니다.20세기 이후 연주자는 마커 사이의 위치나 각도로 움직임을 식별하기 위해 각 관절 근처에 마커를 착용해야 했습니다.음향, 관성, LED, 자기 또는 반사 마커 또는 이들 중 어느 것이든 최적의 주파수 속도의 2배 이상 추적된다.움직임의 흐림이 저해상도와 거의 동일한 문제를 일으키기 때문에 시스템의 해상도는 공간 분해능과 시간 분해능 모두에서 중요합니다.21세기 초부터 그리고 기술의 빠른 성장으로 인해 새로운 방법들이 개발되었습니다.대부분의 최신 시스템은 배경에서 연주자의 실루엣을 추출할 수 있습니다.그 후 수학 모델을 실루엣에 끼워 모든 접합각을 산출한다.실루엣의 변화를 볼 수 없는 이동의 경우,[citation needed] 마커와 실루엣을 모두 수행할 수 있지만 마커 수가 적은 하이브리드 시스템을 사용할 수 있습니다.로봇 공학에서 일부 모션 캡처 시스템은 동시 위치 확인 및 [28]매핑에 기반합니다.

광학계

광학 시스템은 이미지 센서에서 캡처한 데이터를 사용하여 피사체의 3D 위치를 겹치는 투영을 제공하기 위해 보정된 두 개 이상의 카메라 사이에서 삼각 측량합니다.데이터 수집은 전통적으로 행위자에게 부착된 특수 마커를 사용하여 구현되지만, 최근 시스템은 각 특정 피험자에 대해 동적으로 식별된 표면 특징을 추적하여 정확한 데이터를 생성할 수 있습니다.다수의 퍼포먼스를 추적하거나 캡처 영역을 확장하는 것은 카메라를 추가하는 것으로 실현됩니다.이러한 시스템은 각 마커에 대해 3개의 자유도를 가진 데이터를 생성하며, 회전 정보는 3개 이상의 마커(예: 팔꿈치의 각도를 제공하는 어깨, 팔꿈치 및 손목 마커)의 상대적 방향에서 추론해야 한다.새로운 하이브리드 시스템은 관성 센서와 광학 센서를 결합하여 폐색을 줄이고 사용자 수를 늘리며 데이터를 수동으로 정리하지[citation needed] 않고도 추적 기능을 향상시키고 있습니다.

패시브 마커

패시브 광학 시스템은 역반사 재료로 코팅된 마커를 사용하여 카메라 렌즈 근처에서 발생하는 빛을 반사합니다.피부와 천은 무시하고 밝은 반사 마커만 샘플링되도록 카메라 임계값을 조정할 수 있습니다.

마커의 중심은 캡처된 2차원 영상 내의 위치로 추정됩니다.각 픽셀의 그레이스케일 값을 사용하여 가우스 중심을 찾아 하위 픽셀의 정확도를 제공할 수 있습니다.

기존의 위치에 마커를 부착한 물체를 이용해 카메라를 보정해 그 위치를 얻어 각 카메라의 렌즈 왜곡을 측정한다.보정된 두 대의 카메라가 마커를 보면 3차원 픽스를 얻을 수 있습니다.일반적으로 시스템은 약 2~48대의 카메라로 구성됩니다.마커 스왑을 줄이기 위해 300개 이상의 카메라가 있는 시스템이 존재합니다.캡처 대상과 여러 피사체를 완전히 커버하려면 추가 카메라가 필요합니다.

모든 패시브 마커가 동일해 보이기 때문에 벤더에는 마커 스왑 문제를 줄이기 위한 제약 소프트웨어가 있습니다.능동형 마커 시스템 및 자기 시스템과 달리 수동형 시스템은 사용자가 전선이나 전자 [29]장비를 착용할 필요가 없습니다.대신 수백 개의 고무공에 반사 테이프가 부착되어 있어 정기적으로 교체해야 합니다.마커는 보통 (생물역학에서와 같이) 피부에 직접 부착되거나 모션 캡처를 위해 특별히 설계된 전신 스판덱스/라이크라 수트를 착용한 연기자에게 벨크로로 부착됩니다.이런 유형의 시스템은 일반적으로 120~160fps의 프레임 속도로 많은 마커를 캡처할 수 있지만 해상도를 낮추고 관심 영역을 추적함으로써 10,000fps까지 추적할 수 있습니다.

액티브 마커

능동형 광학 시스템은 한 번에 하나의 LED를 매우 빠르게 켜거나 소프트웨어를 사용하여 여러 LED를 점등하여 위치를 삼각 측량합니다. 이는 천체의 항법처럼 상대적인 위치로 식별할 수 있습니다.외부에서 생성된 빛을 반사하는 대신 마커 자체에 자체 빛을 방출하도록 전원이 공급됩니다.역제곱 법칙은 거리의 2배에서 1/4의 검정력을 제공하므로 캡처할 거리와 부피를 늘릴 수 있습니다.또한 높은 신호 대 노이즈 비를 사용할 수 있으므로 마커 지터가 매우 낮아지고 측정 분해능이 높아집니다(보정된 볼륨 내에서 0.1mm까지 낮아지는 경우가 많습니다).

TV 시리즈 스타게이트 SG1은 VFX용 액티브 광학 시스템을 사용하여 다른 비액티브 광학 [citation needed]시스템이 모션 캡처를 어렵게 하는 소품 주변을 걸을 수 있도록 하는 에피소드를 제작했다.

ILM은 드라큘라의 날아다니는 신부들을 잡아내기 위해 반 헬싱에서 활동적인 마커를 사용했다. Weta가 Rise of the Planet of the Planet of the Applains에서 활동적인 마커를 사용한 것과 유사하다.각 마커에 대한 전력은 캡처 시스템을 통해 순차적으로 공급될 수 있으며, 결과 프레임률에 대한 비용으로 특정 캡처 프레임에 대한 각 마커를 고유하게 식별할 수 있습니다.이러한 방식으로 각 마커를 식별하는 기능은 실시간 애플리케이션에서 유용합니다.마커를 식별하는 다른 방법은 데이터를 추가로 처리해야 하는 알고리즘으로 수행하는 것입니다.

또한 컬러 LED 마커를 사용하여 위치를 찾을 수도 있습니다.이러한 시스템에서 각 색상은 신체의 특정 지점에 할당됩니다.

1980년대 초기 능동 마커 시스템 중 하나는 회전 거울과 색유리 반사 마커를 가진 하이브리드 수동-능동형 mocap 시스템이었고, 마스크된 선형 어레이 검출기를 사용했다.

시간 변조 활성 마커

액티브 마커 시스템은 한 번에 하나의 마커를 스트로핑하거나 여러 마커를 시간에 따라 추적하여 진폭 또는 펄스 폭을 변조하여 마커 ID를 제공합니다.12 메가픽셀 공간 분해능 변조 시스템은 공간 분해능과 시간 분해능을 모두 높임으로써 4 메가픽셀 광학 시스템보다 더 미묘한 움직임을 보여줍니다.연출자는 배우의 연기를 실시간으로 볼 수 있고 모션 캡쳐에 의한 CG 캐릭터의 결과를 볼 수 있습니다.고유한 마커 ID는 마커 스왑을 없애고 다른 기술보다 훨씬 깨끗한 데이터를 제공함으로써 턴어라운드를 줄여줍니다.온보드 처리와 무선 동기 기능을 갖춘 LED는 직사광선 아래에서 야외에서 모션 캡처를 할 수 있으며 고속 전자 셔터로 인해 초당 120~960프레임의 속도로 캡처를 할 수 있습니다.변조된 ID의 컴퓨터 처리를 통해 수동 청소나 결과 필터링을 줄일 수 있어 운영 비용을 절감할 수 있습니다.이 높은 정확도와 해상도는 패시브 기술보다 더 많은 처리를 필요로 하지만, 카메라에서 추가 처리를 통해 서브픽셀 또는 중심 처리를 통해 해상도를 향상시켜 고해상도와 고속을 모두 제공합니다.이러한 모션 캡처 시스템은 일반적으로 8대의 카메라에 $20,000, 1대의 액터를 사용하는 1,200만 화소의 공간 해상도 120Hz 시스템입니다.

반수동식 무감각 마커

기존의 고속 카메라 방식을 뒤집을 수 있다.Prakash와 같은 시스템은 저렴한 멀티 LED 고속 프로젝터를 사용합니다.특수 제작된 멀티 LED IR 프로젝터는 공간을 광학적으로 인코딩합니다.시스템은 역반사 또는 활성 발광 다이오드(LED) 마커 대신 감광 마커 태그를 사용하여 광신호를 디코딩합니다.사진 센서가 있는 태그를 씬 포인트에 부착함으로써 태그는 각 포인트의 자체 위치뿐만 아니라 방향, 입사 조명 및 반사율도 계산할 수 있습니다.

이러한 추적 태그는 자연 채광 조건에서 작동하며 복장이나 기타 물체에 눈에 띄지 않게 삽입될 수 있습니다.시스템은 씬(scene)에서 태그 수를 무제한으로 지원하며, 각 태그는 마커 재획득 문제를 제거하기 위해 고유하게 식별됩니다.이 시스템은 고속 카메라와 이에 대응하는 고속 이미지 스트림을 제거하므로 데이터 대역폭이 크게 낮아집니다.태그는 합성 요소를 삽입할 때 장면 조명을 일치시키는 데 사용할 수 있는 입사 조명 데이터도 제공합니다.이 기술은 가상 세트의 온세트 모션 캡처 또는 실시간 브로드캐스트에 이상적인 것으로 보이지만 아직 검증되지 않았습니다.

수중 모션 캡처 시스템

모션 캡처 기술은 수십 년 동안 연구자들과 과학자들에게 이용되어 왔고, 이것은 많은 분야에 대한 새로운 통찰력을 주었다.

수중 카메라

시스템의 중요한 부분인 수중 카메라는 방수 하우징을 갖추고 있습니다.하우징은 부식과 염소를 견딜 수 있는 마감재가 있어 분지나 수영장에서 사용하기에 완벽합니다.카메라는 두 종류가 있습니다.산업용 고속 카메라는 적외선 카메라로도 사용할 수 있다.적외선 수중 카메라에는 일반적인 IR 라이트 대신 시안 라이트 스트로보가 포함되어 있습니다.수중에서의 낙하를 최소한으로 억제할 수 있습니다.또, LED 라이트가 있는 고속 카메라 콘이나 화상 처리의 옵션도 준비되어 있습니다.

측정량

수중 카메라는 일반적으로 수질, 카메라 및 사용된 표식의 종류에 따라 15-20m를 측정할 수 있습니다.당연히 물이 맑을 때 최상의 범위가 달성되며, 항상 그렇듯이 측정 부피도 카메라 수에 따라 달라집니다.다양한 상황에서 다양한 수중 표지를 사용할 수 있습니다.

맞춤

풀마다 필요한 설치 및 고정 장치가 다릅니다.따라서, 모든 수중 모션 캡처 시스템은 각각의 특정 수영장 설비에 적합하도록 독특하게 조정된다.수영장 중앙에 설치된 카메라의 경우 흡착판을 사용하여 특별히 설계된 삼각대가 제공됩니다.

마커리스

컴퓨터 비전의 새로운 기술과 연구는 모션 캡쳐에 대한 마커리스 접근법의 빠른 발전으로 이어지고 있습니다.스탠포드 대학, 메릴랜드 대학, MIT, 맥스 플랑크 연구소에서 개발된 마커리스 시스템은 피실험자들이 추적을 위해 특별한 장비를 착용할 필요가 없다.특수 컴퓨터 알고리즘은 시스템이 여러 개의 광학 입력 스트림을 분석하여 인간의 형태를 식별하여 추적하기 위한 구성 부품으로 분할할 수 있도록 설계되었습니다.Warner Brothers Pictures의 자회사인 ESC Entertainment는 The Matrix Reloaded와 The Matrix Revolutions 영화를 촬영하기 위한 사실적인 디지털 룩을 포함하여 가상 촬영이 가능하도록 특별히 만들어진 Universal Capture라고 불리는 기술을 사용했습니다. 이 기술은 7개의 카메라 설정과 모든 픽셀의 광학 흐름을 추적하는 것을 이용했습니다.ll 동작, 제스처 및 표정 캡처를 위한 카메라의 2-D 평면을 통해 사실적인 결과를 얻을 수 있습니다.

종래의 시스템

전통적으로 마커리스 광학 모션 트래킹은 비행기, 발사체, 미사일 및 위성을 포함한 다양한 물체를 추적하는 데 사용됩니다.이러한 광동작 추적 어플리케이션의 대부분은 야외에서 발생하므로 렌즈와 카메라 구성이 다릅니다.따라서 추적 대상물의 고해상도 화상은 단순한 모션 데이터보다 더 많은 정보를 제공할 수 있다.챌린저호의 치명적인 발사에 대한 NASA의 장거리 추적 시스템에서 얻은 이미지는 사고의 원인에 대한 결정적인 증거를 제공했다.광학 추적 시스템은 또한 물체가 충분한 [30]빛을 반사하거나 방출해야 한다는 점에서 레이더에 비해 단점이 있음에도 불구하고 알려진 우주선과 우주 파편을 식별하기 위해 사용된다.

광학 추적 시스템은 일반적으로 광학 이미징 시스템, 기계 추적 플랫폼 및 추적 컴퓨터의 세 가지 서브시스템으로 구성됩니다.

광학 이미징 시스템은 대상 영역의 빛을 추적 컴퓨터가 처리할 수 있는 디지털 이미지로 변환하는 역할을 합니다.광학 추적 시스템의 설계에 따라, 광학 이미징 시스템은 표준 디지털 카메라처럼 단순한 것에서부터 산꼭대기에 있는 천체 망원경처럼 특수화된 것까지 다양할 수 있습니다.광학 이미징 시스템의 사양은 추적 시스템의 유효 범위의 상한을 결정합니다.

기계적 추적 플랫폼은 광학 이미징 시스템을 보유하고 있으며 항상 추적 대상 대상을 가리키도록 광학 이미징 시스템을 조작하는 역할을 합니다.광학 이미징 시스템과 결합된 기계식 추적 플랫폼의 역동성은 속도가 빠르게 변화하는 표적에 대한 잠금을 유지하는 추적 시스템의 능력을 결정합니다.

추적 컴퓨터는 광학 영상 시스템에서 영상을 캡처하고, 영상을 분석하여 목표 위치를 추출하고, 목표물을 따라가도록 기계 추적 플랫폼을 제어하는 역할을 합니다.몇 가지 과제가 있습니다.우선 추적 컴퓨터는 비교적 높은 프레임 레이트로 이미지를 캡처할 수 있어야 합니다.이를 통해 이미지 캡처 하드웨어 대역폭에 대한 요구사항이 게시됩니다.두 번째 과제는 이미지 처리 소프트웨어가 배경에서 대상 이미지를 추출하여 위치를 계산할 수 있어야 한다는 것입니다.이 작업에는 몇 가지 교과서 이미지 처리 알고리즘이 설계되어 있습니다.추적 시스템이 추적하는 모든 타깃에서 공통되는 특정 특성을 예상할 수 있는 경우 이 문제를 단순화할 수 있습니다.다음 문제는 추적 플랫폼을 제어하여 대상을 추적하는 것입니다.이는 시스템 다이내믹스를 모델링하고 제어하기 위한 컨트롤러를 설계해야 하는 과제라기보다는 일반적인 제어 시스템 설계 문제입니다.다만, 시스템이 조작할 필요가 있는 트래킹 플랫폼이 리얼타임용으로 설계되어 있지 않은 경우는, 이것이 과제가 됩니다.

이러한 시스템을 실행하는 소프트웨어도 해당 하드웨어 컴포넌트에 맞게 커스터마이즈됩니다.그러한 소프트웨어의 한 예는 OpticalTracker인데, 이것은 컴퓨터화된 망원경을 조종하여 비행기나 위성 같은 먼 거리에 있는 물체를 추적한다.또 다른 옵션은 소프트웨어 SimiShape로, 마커와 함께 하이브리드를 사용할 수도 있습니다.

RGB-D 카메라

키넥트 등의 RGB-D카메라는 색상과 깊이 이미지를 모두 캡처합니다.두 이미지를 융합함으로써 3D 컬러 복셀을 캡처할 수 있어 3D 인체 움직임과 인체 표면을 실시간으로 모션 캡처할 수 있습니다.

싱글 뷰 카메라를 사용하기 때문에 캡처된 모션에는 보통 노이즈가 있습니다.게으른[31] 학습 및 가우스 [32]모델과 같은 방법을 사용하여 그러한 잡음 운동을 더 높은 품질의 운동으로 자동 재구성하는 기계 학습 기술이 제안되었다.이러한 방법은 인체공학적 [33]평가와 같은 심각한 응용 분야에 충분히 정확한 움직임을 생성합니다.

비광학계

관성계

관성 모션[34] 캡처 기술은 소형 관성 센서, 생체역학 모델 및 센서 융합 알고리즘을 [35]기반으로 합니다.관성 센서(관성 유도 시스템)의 움직임 데이터는 종종 무선으로 컴퓨터로 전송되며, 여기서 움직임이 기록되거나 표시됩니다.대부분의 관성 시스템은 회전 속도를 측정하기 위해 자이로스코프, 자력계 및 가속도계의 조합을 포함하는 관성 측정 장치(IMU)를 사용합니다.이러한 회전은 소프트웨어의 골격으로 변환됩니다.광학 마커와 마찬가지로 IMU 센서가 많을수록 데이터가 자연스러워집니다.원하는 경우 사용자의 절대 위치를 제공해야 하지만 상대적인 움직임을 위해 외부 카메라, 이미터 또는 마커가 필요하지 않습니다.관성 모션 캡처 시스템은 사람의 6가지 자유도 신체 움직임을 실시간으로 캡처하며, 자기 베어링 센서가 포함된 경우 분해능이 훨씬 낮고 전자파 노이즈의 영향을 받기 쉽지만 제한적인 방향 정보를 제공할 수 있습니다.관성 시스템을 사용하면 좁은 공간, 해결 방법 없음, 휴대성, 대형 캡처 영역 등 다양한 환경에서 캡처할 수 있습니다.단점은 시간이 지남에 따라 더 복잡해질 수 있는 낮은 위치 정확도와 위치 드리프트입니다.이 시스템은 Wii 컨트롤러와 비슷하지만 더 민감하고 해상도와 업데이트 속도가 더 높습니다.지면에 대한 방향을 어느 정도 정확하게 측정할 수 있습니다.관성 시스템의 인기는 게임 개발자들 [10]사이에서 상승하고 있는데, 이는 주로 빠른 파이프라인을 만드는 빠르고 쉬운 설정 때문이다.현재 다양한 제조업체에서 다양한 정장을 구입할 수 있으며 기본 가격은 1,000달러에서 80,000달러입니다.

기계 운동

기계적 모션 캡처 시스템은 신체 관절 각도를 직접 추적하며 센서가 신체에 부착되는 방식 때문에 종종 외골격 모션 캡처 시스템이라고 합니다.연주자는 골격과 같은 구조를 그들의 몸에 붙이고, 그들이 움직일 때, 연주자의 상대적인 움직임을 측정하면서 관절 기계 부품도 붙인다.기계식 모션 캡처 시스템은 비교적 저렴한 실시간 시스템이며 폐색이 없으며 캡처 볼륨이 무제한인 무선(제한되지 않음) 시스템입니다.전형적으로, 그것들은 신체의 관절에서 관절이 되는 전위차계와 함께 연결된 접합된 직선 금속 또는 플라스틱 막대의 단단한 구조물이다.이 정장은 25,000달러에서 75,000달러 범위와 외부 절대 위치 확인 시스템입니다.일부 수트는 제한된 힘 피드백 또는 촉각 입력을 제공합니다.

자기계

자기 시스템은 송신기와 각 [36]수신기의 3개의 직교 코일의 상대 자속으로 위치와 방향을 계산합니다.3개의 코일의 전압 또는 전류의 상대적인 강도를 통해 추적 볼륨을 꼼꼼히 매핑하여 범위와 방향을 모두 계산할 수 있습니다.센서 출력은 6DOF이며, 광학 시스템에 필요한 마커 수의 3분의 2(상부 암과 하부 암의 팔꿈치 위치 [citation needed]및 각도)로 얻은 유용한 결과를 제공합니다.마커는 비금속 물체에 의해 차단되지 않지만 자기장에 영향을 미치는 철근(콘크리트 내 강철 철근)이나 배선, 모니터, 조명, 케이블 및 컴퓨터와 같은 전기 소스의 자기 및 전기적 간섭에 취약합니다.센서 응답은 특히 캡처 영역의 가장자리에 대해 비선형적입니다.센서의 배선은 극단적인 성능 [36]이동을 방지하는 경향이 있습니다.자기 시스템을 사용하면 [36]모션 캡처 세션의 결과를 실시간으로 모니터링할 수 있습니다.자기 시스템의 캡처 볼륨은 광학 시스템의 캡처 볼륨보다 현저히 작습니다.자기 시스템의 경우 교류(AC) 시스템과 직류(DC) 시스템은 사각 펄스를 사용하고 AC 시스템은 사인파 펄스를 사용합니다.

스트레치 센서

스트레치 센서는 신축성, 굽힘, 전단 또는 압력을 측정하는 플렉시블 평행판 캐패시터이며 일반적으로 실리콘으로 제조됩니다.센서가 늘어나거나 스퀴즈하면 커패시턴스 값이 변경됩니다.이 데이터는 블루투스 또는 직접 입력을 통해 전송될 수 있으며 신체 동작의 미세한 변화를 감지하는 데 사용됩니다.스트레치 센서는 자기 간섭의 영향을 받지 않으며 간섭이 없습니다.또한 센서의 신축성은 관성 시스템에서 흔히 볼 수 있는 위치 표류에 시달리지 않음을 의미합니다.반면 신축성 센서는 기판과 전도성 재료의 특성으로 인해 상대적으로 높은 신호 대 잡음비로 인해 모션 캡처에 사용할 수 있도록 필터링 또는 기계 학습이 필요합니다.이러한 솔루션을 사용하면 다른 센서에 비해 지연 시간이 길어집니다.

관련 기술

얼굴 동작 캡처

대부분의 기존 모션 캡처 하드웨어 벤더는 액티브 또는 패시브 마커 시스템을 사용하여 32~300개의 마커를 사용하는 일종의 저해상도 얼굴 캡처를 제공합니다.이러한 솔루션은 모두 마커를 적용하고 위치를 보정하며 데이터를 처리하는 데 걸리는 시간에 따라 제한됩니다.궁극적으로 이 기술은 해상도와 원시 출력 품질 수준도 제한합니다.

퍼포먼스 캡쳐라고도 불리는 고화질 얼굴 모션 캡쳐는 다음 세대의 충실도이며 더 높은 수준의 감정을 포착하기 위해 사람 얼굴의 더 복잡한 움직임을 기록하는 데 사용됩니다.얼굴 캡처는 현재 전통적인 모션 캡처 데이터, 혼합형 기반 솔루션, 배우 얼굴의 실제 토폴로지 캡처, 독점 시스템 등 몇 가지 다른 진영에 배치되어 있습니다.

두 가지 주요 기술은 여러 각도에서 얼굴 표정을 캡처하고 OpenCV의 스테레오 메쉬 솔버와 같은 소프트웨어를 사용하여 3D 표면 메쉬를 만들거나 광원, 카메라 위치 등의 밝기 변화로부터 표면 규범을 계산하는 고정 시스템입니다.또는 둘 다 변경됩니다.이러한 기술은 카메라 해상도, 외관상 물체 크기 및 카메라 수에 따라 기능 해상도가 제한되는 경향이 있습니다.사용자의 얼굴이 카메라 작업 면적의 50%이고 카메라가 메가픽셀 해상도라면 프레임을 비교해 밀리미터 이하의 얼굴 움직임을 검출할 수 있다.최근 작업은 액터와 그 표정을 3D 메시로 만드는 것이 아니라 프레임 레이트를 높이고 다른 컴퓨터로 생성된 얼굴로 모션의 대상을 변경할 수 있도록 광학 플로우를 하는 데 초점을 맞추고 있습니다.

RF 포지셔닝

RF(무선 주파수) 포지셔닝 시스템은 고주파수 RF 장치가 기존 RF 기술(레이더 등)보다 더 높은 정밀도를 가능하게 함에 따라 더욱[citation needed] 실용화되고 있습니다.빛의 속도는 30cm/나노초(10억분의 1초)이기 때문에 10기가헤르츠(초당 10억 사이클) RF신호는 약 3cm의 정밀도가 가능하다.4분의 1 파장까지의 진폭을 측정함으로써 분해능을 약 8 mm까지 향상시킬 수 있습니다.광학계의 해상도를 달성하려면 50기가헤르츠 이상의 주파수가 필요한데, 이는 거의 광학계만큼 시야에 의존하며 차단이 쉽다.신호의 멀티패스 및 재방사는 추가적인 문제를 일으킬 가능성이 높지만 100m 거리에서 필요한 분해능이 높지 않기 때문에 이러한 기술은 상당한 정확도로 더 큰 볼륨을 추적하는 데 이상적입니다.많은 RF 과학자들은[who?] 무선 주파수가 모션 캡처에 필요한 정확도를 결코 만들어내지 못할 것이라고 믿고 있습니다.

매사추세츠 공과대학의 연구원들은 2015년에 RF [37]추적이라고 불리는 RF 신호에 의해 움직임을 추적하는 시스템을 만들었다고 말했다.

비기존 시스템

햄스터 볼과 유사한 회전구를 사용하여 배우에게 무제한 보행 영역을 제공하는 대안 접근법이 개발되었으며, 이 구에는 각도의 움직임을 기록하는 내부 센서가 포함되어 있어 외부 카메라와 기타 장비가 필요하지 않습니다.이 기술은 모션 캡처 비용을 훨씬 낮출 수 있지만 기본 구면에서는 단일 연속 방향만 기록할 수 있습니다.더 많은 것을 기록하기 위해서는 그 사람에게 착용한 추가 센서가 필요할 것이다.

또 다른 대안은 6DOF(자유도) 모션 플랫폼과 고해상도 광학 모션 캡처 기능이 있는 통합 전방위 트레드밀을 사용하여 동일한 효과를 달성하는 것입니다.붙잡힌 사람은 각기 다른 울퉁불퉁한 지형을 협상하며 무제한 지역을 걸을 수 있다.응용 프로그램에는 균형 훈련, 생체 기계 연구 및 가상 [citation needed]현실을 위한 의료 재활이 포함됩니다.

3D 포즈 추정

3D 포즈 추정에서는 배우의 포즈를 이미지 또는 깊이 [38]맵에서 재구성할 수 있습니다.

「 」를 참조해 주세요.

- 애니메이션 데이터베이스

- 제스처 인식

- 핑거 트래킹

- 역운동학(CGI 효과를 현실화하는 다른 방법)

- Kinect (Microsoft Corporation에서 작성)

- 모션 및 제스처 파일 형식 목록

- 모션 캡처 연기

- 비디오 추적

- VR 위치 추적

레퍼런스

- ^ Goebl, W.; Palmer, C. (2013). Balasubramaniam, Ramesh (ed.). "Temporal Control and Hand Movement Efficiency in Skilled Music Performance". PLOS ONE. 8 (1): e50901. Bibcode:2013PLoSO...850901G. doi:10.1371/journal.pone.0050901. PMC 3536780. PMID 23300946.

- ^ Olsen, NL; Markussen, B; Raket, LL (2018), "Simultaneous inference for misaligned multivariate functional data", Journal of the Royal Statistical Society, Series C, 67 (5): 1147–76, arXiv:1606.03295, doi:10.1111/rssc.12276, S2CID 88515233

- ^ 데이비드 누난, 피터 마운트니, 대니얼 엘슨, 아라 다르지, 광중 양.최소 침습 수술 중 카메라 모션 및 3D 깊이 복구를 위한 입체 섬유 현미경입니다.Proc ICRA 2009, 페이지 4463–68. http://www.sciweavers.org/external.php?u=http%3A%2F%2Fwww.doc.ic.ac.uk%2F%7Epmountne%2Fpublications%2FICRA%25202009.pdf&p=ieee

- ^ 야마네, 카츠, 제시카 하진스."인간 모션 캡처 데이터를 모방하기 위한 휴머노이드 로봇의 동시 추적 및 균형 조정"Intelligent Robots and Systems, 2009.IROS 2009.IEEE/RSJ 국제회의 on.IEEE, 2009.

- ^ NY 캐스팅, Joe Gatt, 모션 캡처 배우: 2014년 6월 21일 액세스된 웨이백 머신에서 2014-07-03년에 보관된 이야기를 전하는 차체 이동

- ^ Andrew Harris Salomon, 2013년 2월 22일, Backstage Magazine, Grow In Performance Capture Helping Gaming Actors Weather Sloff, 2014년 6월 21일 액세스.그러나 모션 캡쳐 기술의 발전과 올해 안에 소니와 마이크로소프트로부터 기대되는 새로운 게임 콘솔은 이 틈새가 계속해서 배우들의 성장 영역임을 보여준다.침입을 생각해본 분들을 위해, 메시지는 명확합니다.바빠지다..."

- ^ 벤 차일드, 2011년 8월 12일, 가디언, 앤디 서키스: 왜 오스카는 모션 캡쳐 연기에 열광하지 않을까? Star of the Planet of the Planet of the Planet of the Applains는 퍼포먼스 캡쳐가 오해되고 있으며 배우들은 더 존중받을 가치가 있다고 말합니다.2014년 6월 21일 액세스

- ^ Hugh Hart, 2012년 1월 24일자, Wired 잡지, 모션 캡처 배우가 오스카상을 받는 것은 언제입니까? 2014년 6월 21일 "...영화예술과학아카데미의 모션 캡처 퍼포먼스에 대한 역사적 거부감"에 접속했다.센서 내장 라이크라 바디 슈트를 입은 서키스는 당시 신예 예술과 퍼포먼스 캡쳐 연기의 과학을 빠르게 습득했다."

- ^ 청, 독일 KM 등"인간 동작의 강력한 3D 복셀 재구성을 위한 실시간 시스템입니다."컴퓨터 비전과 패턴 인식, 2000.의사진행동.IEEE 회의 온Vol. 2. IEEE, 2000.

- ^ a b "Xsens MVN Animate – Products". Xsens 3D motion tracking. Retrieved 2019-01-22.

- ^ "The Next Generation 1996 Lexicon A to Z: Motion Capture". Next Generation. No. 15. Imagine Media. March 1996. p. 37.

- ^ "Motion Capture". Next Generation. Imagine Media (10): 50. October 1995.

- ^ Jon Radoff, MMORPG 해부학, CS1 유지보수: 제목으로 아카이브된 복사 (링크)

- ^ a b "Hooray for Hollywood! Acclaim Studios". GamePro. IDG (82): 28–29. July 1995.

- ^ Mason, Graeme. "Martech Games - The Personality People". Retro Gamer. No. 133. p. 51.

- ^ "Pre-Street Fighter II Fighting Games". Hardcore Gaming 101. p. 8. Retrieved 26 November 2021.

- ^ "Sega Saturn exclusive! Virtua Fighter: fighting in the third dimension" (PDF). Computer and Video Games. No. 158 (January 1995). Future plc. 15 December 1994. pp. 12–3, 15–6, 19.

- ^ "Virtua Fighter". Maximum: The Video Game Magazine. Emap International Limited (1): 142–3. October 1995.

- ^ Wawro, Alex (October 23, 2014). "Yu Suzuki Recalls Using Military Tech to Make Virtua Fighter 2". Gamasutra. Retrieved 18 August 2016.

- ^ "History of Motion Capture". Motioncapturesociety.com. Archived from the original on 2018-10-23. Retrieved 2013-08-10.

- ^ "Coin-Op News: Acclaim technology tapped for "Batman" movie". Play Meter. Vol. 20, no. 11. October 1994. p. 22.

- ^ "Acclaim Stakes its Claim". RePlay. Vol. 20, no. 4. January 1995. p. 71.

- ^ Savage, Annaliza (12 July 2012). "Gollum Actor: How New Motion-Capture Tech Improved The Hobbit". Wired. Retrieved 29 January 2017.

- ^ "Markerless Motion Capture EuMotus". Markerless Motion Capture EuMotus. Retrieved 2018-10-12.

- ^ Corriea, Alexa Ray (30 June 2014). "This facial recognition software lets you be Octodad". Retrieved 4 January 2017 – via www.polygon.com.

- ^ Plunkett, Luke. "Turn Your Human Face Into A Video Game Character". kotaku.com. Retrieved 4 January 2017.

- ^ "Put your (digital) game face on". fxguide.com. 24 April 2016. Retrieved 4 January 2017.

- ^ 스투름 위르겐 등"RGB-D SLAM 시스템 평가 벤치마크"IROS(Intelligent Robots and Systems), 2012 IEEE/RSJ 국제회의 개최.IEEE, 2012.

- ^ "Motion Capture: Optical Systems". Next Generation. Imagine Media (10): 53. October 1995.

- ^ Veis, G. (1963). "Optical tracking of artificial satellites". Space Science Reviews. 2 (2): 250–296. Bibcode:1963SSRv....2..250V. doi:10.1007/BF00216781. S2CID 121533715.

- ^ Shum, Hubert P. H.; Ho, Edmond S. L.; Jiang, Yang; Takagi, Shu (2013). "Real-Time Posture Reconstruction for Microsoft Kinect". IEEE Transactions on Cybernetics. 43 (5): 1357–1369. doi:10.1109/TCYB.2013.2275945. PMID 23981562. S2CID 14124193.

- ^ Liu, Zhiguang; Zhou, Liuyang; Leung, Howard; Shum, Hubert P. H. (2016). "Kinect Posture Reconstruction based on a Local Mixture of Gaussian Process Models" (PDF). IEEE Transactions on Visualization and Computer Graphics. 22 (11): 2437–2450. doi:10.1109/TVCG.2015.2510000. PMID 26701789. S2CID 216076607.

- ^ Plantard, Pierre; Shum, Hubert P. H.; Pierres, Anne-Sophie Le; Multon, Franck (2017). "Validation of an Ergonomic Assessment Method using Kinect Data in Real Workplace Conditions". Applied Ergonomics. 65: 562–569. doi:10.1016/j.apergo.2016.10.015. PMID 27823772.

- ^ "Full 6DOF Human Motion Tracking Using Miniature Inertial Sensors" (PDF).

- ^ "A history of motion capture". Xsens 3D motion tracking. Retrieved 2019-01-22.

- ^ a b c "Motion Capture: Magnetic Systems". Next Generation. Imagine Media (10): 51. October 1995.

- ^ Alba, Alejandro. "MIT researchers create device that can recognize, track people through walls". nydailynews.com. Retrieved 2019-12-09.

- ^ Ye, Mao, et al."단일 깊이 이미지에서 정확한 3D 포즈 추정." 2011년 국제 컴퓨터 비전 컨퍼런스IEEE, 2011.

외부 링크

| 라이브러리 리소스 정보 모션 캡처 |