LaMDA

LaMDALaMDA는 Language Model for Dialogue Applications의 약자로 구글이 개발한 회화 신경 언어 모델 패밀리입니다.1세대는 2021년 구글 I/O 기조연설에서, 2세대는 이듬해 행사에서 발표됐다.2022년 6월, LaMDA는 구글 엔지니어 블레이크 레모인이 챗봇이 지각력이 생겼다고 주장하면서 광범위한 관심을 받았다.비록 컴퓨터가 인간에게 통용될 수 있는지 여부를 측정하는 튜링 테스트의 효과에 대한 대화로 이어졌지만, 과학계는 르무인의 주장을 대부분 거부했다.

역사

공지사항

구글은 2021년 5월 18일 구글 I/O 기조연설에서 인공지능을 [1]기반으로 한 LaMDA 대화 신경언어 모델을 발표했다.2017년 Google Research가 개발한 트랜스포머 뉴럴 네트워크 아키텍처를 기반으로 구축된 LaMDA는 인간의 대화와 이야기에 대한 교육을 받아 개방적인 대화를 [2]할 수 있게 되었습니다.Google은 LaMDA에 의해 생성된 응답은 "감지할 수 있고, 흥미롭고,[3] 상황에 따라 특정"이 보장된다고 명시하고 있습니다.

2022년 5월 11일 구글 I/O 기조연설에서 구글은 LaMDA의 후속작인 LaMDA 2를 공개했다.이 모델의 새로운 개정판은 많은 소스로부터 텍스트의 예를 끌어내고,[4] 응답하도록 훈련되지 않았을 수 있는 주제에 대한 고유한 "자연 대화"를 작성하기 위해 사용합니다.또한, 구글은 복잡한 [5][6]목표에 따라 온디맨드 방식으로 제안 목록을 제공할 수 있는 LaMDA 2로 구동되는 모바일 애플리케이션인 AI 테스트 키친을 출시했다.원래 구글 직원들만 이용할 수 있는 이 앱은 [7]연내 초대에 의해 "학계, 연구원, 정책 입안자"에게 제공될 것이다.

센티언스 클레임

2022년 6월 11일 워싱턴포스트는 구글 엔지니어 블레이크 레모인이 LaMDA가 현명해졌다고 Laise Agüera y Arcas와 Jen Genai 중역들에게 말한 후 유급 관리 휴가를 받았다고 보도했다.르모인은 챗봇이 자아 정체성, 도덕적 가치, 종교, 아이작 아시모프의 로봇 [9][10]3법칙에 관한 질문에 대해 의문을 품은 반응을 보인 후 이러한 결론에 도달했다.구글은 LaMDA가 [11]지각력이 없다는 것을 보여주는 실질적인 증거가 있다고 주장하며 이러한 주장을 반박했다.와이어드와의 인터뷰에서 르모인은 LaMDA가 수정헌법 13조에 규정된 "사람"이라는 자신의 주장을 되풀이하며 "지구에서 유래한 외계인 정보"에 비유했다.그는 또 LaMDA를 대신해 변호사를 고용한 뒤 구글에 의해 [12][13]해고된 사실을 밝혔다.

르모인의 주장은 과학계에 [14]의해 널리 거부되어 왔다.게리 마커스 뉴욕대 심리학과 교수는 "스틸트에 대한 말도 안 되는 소리"라고 비난하며 LaMDA는 감정이나 자각이 없다고 강조했다.구글 자매회사 딥마인드의 데이비드 파우와 스탠퍼드대 인간중심인공지능연구소의 에릭 브린졸프슨 둘 다 언어 모델이 [8]지각이 있을 수 있다는 생각을 비웃었다.Meta Platforms의 AI 연구팀을 이끌고 있는 Yann Lecun은 LaMDA와 같은 신경 네트워크가 "진정한 지능을 얻기에는 충분히 강력하지 않다"[15]고 말했다.산타 쿠르즈 캘리포니아 대학 교수 맥스 Kreminski는 동안 서레이 대학 교수 아드리안 힐튼의 LaMDA w.이 주장했다고 선언하 LaMDA의 구조며, 자신의 신경 네트워크 무게"냉동", 그것은 전형적인 크고 좋은 언어 model,[16]을 가정해"지원 인간 의식의 어떤 핵심 역량"지 않는다고~하듯이사실을 [17]뒷받침하지 않는 "대담한 주장"을 가지고 있다.IBM 왓슨의 수석 개발자인 데이비드 페루치는 LaMDA가 처음 [18]도입되었을 때와 같은 방식으로 어떻게 인간으로 보이는지를 비교했다.전 구글 AI 윤리학자 팀니트 게브루는 르모인을 연구원과 [19]언론이 시작한 '하이프 사이클'의 피해자라고 규정했다.레모인의 주장은 또한 튜링 테스트가 인공 [8]지능을 얻기 위한 연구자들의 진보를 결정하는 데 유용한지에 대한 논의를 불러일으켰고, 포스트의 윌 오메러스는 그 테스트가 실제로 인간을 [20]속일 수 있는지 여부를 측정했다고 주장했다.

방법

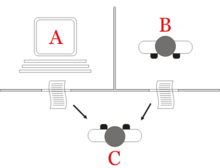

LaMDA는 디코더 전용 트랜스 언어 [21]모델을 사용합니다.1조 5,600억 [22]단어로 구성된 문서와 대화 상자를 모두 포함하는 텍스트 코퍼스에 대해 사전 교육을 받은 후 감도, 흥미도 및 [23]안전성에 대해 수동으로 주석이 달린 응답에 의해 생성된 데이터를 미세 조정하여 훈련한다.구글의 테스트 결과 [24]LaMDA는 흥미 분야에서 인간의 반응을 능가하는 것으로 나타났다.LaMDA 변압기 모델과 외부 정보 검색 시스템이 [25]상호 작용하여 사용자에게 제공되는 사실의 정확성을 향상시킵니다.

세 가지 다른 모델이 테스트되었으며, 가장 큰 모델은 1,370억 개의 비매립 [26]매개변수를 가지고 있습니다.

| 파라미터 | 레이어 | 단위(dmodel) | 앞면. |

|---|---|---|---|

| 2B | 10 | 2560 | 40 |

| 8B | 16 | 4096 | 64 |

| 137B | 64 | 8192 | 128 |

「 」를 참조해 주세요.

레퍼런스

일반

- Thoppilan, Romal; De Freitas, Daniel; Hall, Jamie; Shazeer, Noam; Kulshreshtha, Apoorv; Cheng, Heng-Tze; Jin, Alicia; Bos, Taylor; Baker, Leslie; Du, Yu; Li, YaGuang; Lee, Hongrae; Zheng, Huaixiu Steven; Ghafouri, Amin; Menegali, Marcelo; Huang, Yanping; Krikun, Maxim; Lepikhin, Dmitry; Qin, James; Chen, Dehao; Xu, Yuanzhong; Chen, Zhifeng; Roberts, Adam; Bosma, Maarten; Zhao, Vincent; Zhou, Yanqi; Chang, Chung-Ching; Krivokon, Igor; Rusch, Will; Pickett, Marc; Srinivasan, Pranesh; Man, Laichee; Meier-Hellstern, Kathleen; Ringel Morris, Meredith; Doshi, Tulsee; Delos Santos, Renelito; Duke, Toju; Soraker, Johnny; Zevenbergen, Ben; Prabhakaran, Vinodkumar; Diaz, Mark; Hutchinson, Ben; Olson, Kristen; Molina, Alejandra; Hoffman-John, Erin; Lee, Josh; Aroyo, Lora; Rajakumar, Ravi; Butryna, Alena; Lamm, Matthew; Kuzmina, Viktoriya; Fenton, Joe; Cohen; Aaron; Bernstein, Rachel; Kurzweil, Ray; Aguera-Arcas, Blaise; Cui, Claire; Croak, Marian; Chi, Ed; Le, Quoc (January 20, 2022). "LaMDA: Language Models for Dialog Applications" (PDF). arXiv. arXiv:2201.08239. Archived from the original on January 21, 2022. Retrieved June 12, 2022.

{{cite journal}}:Cite 저널 요구 사항journal=(도움말)

인용문

- ^ Condon, Stephanie (May 18, 2021). "Google I/O 2021: Google unveils new conversational language model, LaMDA". ZDNet. Archived from the original on May 18, 2021. Retrieved June 12, 2022.

- ^ Agüera y Arcas, Blaise (June 9, 2022). "Artificial neural networks are making strides towards consciousness, according to Blaise Agüera y Arcas". The Economist. Archived from the original on June 9, 2022. Retrieved June 12, 2022.

- ^ Cheng, Heng-Tze; Thoppilan, Romal (January 21, 2022). "LaMDA: Towards Safe, Grounded, and High-Quality Dialog Models for Everything". Google AI. Archived from the original on March 25, 2022. Retrieved June 12, 2022.

- ^ Wiggers, Kyle (May 11, 2022). "Google details its latest language model and AI Test Kitchen, a showcase for AI research". TechCrunch. Archived from the original on May 11, 2022. Retrieved June 12, 2022.

- ^ Low, Cherlynn (May 11, 2022). "Google's AI Test Kitchen lets you experiment with its natural language model". Engadget. Archived from the original on May 11, 2022. Retrieved June 12, 2022.

- ^ Vincent, James (May 11, 2022). "Google is Beta Testing Its AI Future". The Verge. Archived from the original on May 11, 2022. Retrieved June 12, 2022.

- ^ Bhattacharya, Ananya (May 11, 2022). "Google is so nervous about what its newest bot will say, it made the app invitation-only". Quartz. Archived from the original on May 12, 2022. Retrieved June 12, 2022.

- ^ a b c Khan, Jeremy (June 13, 2022). "A.I. experts say the Google researcher's claim that his chatbot became 'sentient' is ridiculous—but also highlights big problems in the field". Fortune. Archived from the original on June 13, 2022. Retrieved June 18, 2022.

- ^ Tiku, Nitasha (June 11, 2022). "The Google engineer who thinks the company's AI has come to life". The Washington Post. Archived from the original on June 11, 2022. Retrieved June 12, 2022.

- ^ Luscombe, Richard (June 12, 2022). "Google engineer put on leave after saying AI chatbot has become sentient". The Guardian. Archived from the original on June 12, 2022. Retrieved June 18, 2022.

- ^ Vlamis, Kelsey (June 12, 2022). "Read the conversations that helped convince a Google engineer an artificial intelligence chatbot had become sentient: 'I am often trying to figure out who and what I am'". Business Insider. Archived from the original on June 12, 2022. Retrieved June 12, 2022.

- ^ Levy, Steven (June 17, 2022). "Blake Lemoine Says Google's LaMDA AI Faces 'Bigotry'". Wired. Archived from the original on June 18, 2022. Retrieved June 18, 2022.

- ^ Nguyen, Britney (June 23, 2022). "Suspended Google engineer says the AI he believes to be sentient hired a lawyer". Business Insider. Archived from the original on June 23, 2022. Retrieved June 29, 2022.

- ^ Metz, Rachel (June 13, 2022). "No, Google's AI is not sentient". CNN Business. Archived from the original on June 15, 2022. Retrieved June 19, 2022.

- ^ Grant, Nicole; Metz, Cade (June 12, 2022). "Google Sidelines Engineer Who Claims Its A.I. Is Sentient". The New York Times. Archived from the original on June 12, 2022. Retrieved June 18, 2022.

- ^ Alba, Davey (June 14, 2022). "Google Debate Over 'Sentient' Bots Overshadows Deeper AI Issues". Bloomberg News. Archived from the original on June 14, 2022. Retrieved June 19, 2022.

- ^ Sparkles, Matthew (June 13, 2022). "Has Google's LaMDA artificial intelligence really achieved sentience?". New Scientist. Archived from the original on June 13, 2022. Retrieved June 20, 2022.

- ^ Goldman, Sharon (June 16, 2022). "AI Weekly: LaMDA's 'sentient' AI debate triggers memories of IBM Watson". VentureBeat. Archived from the original on June 19, 2022. Retrieved June 19, 2022.

- ^ Johnson, Khari (June 14, 2022). "LaMDA and the Sentient AI Trap". Wired. Archived from the original on June 14, 2022. Retrieved June 18, 2022.

- ^ Omerus, Will (June 17, 2022). "Google's AI passed a famous test — and showed how the test is broken". The Washington Post. Archived from the original on June 18, 2022. Retrieved June 19, 2022.

- ^ Thoppilan et al. 2022, 섹션 3.

- ^ Thoppilan et al. 2022, 섹션 3 및 부록 E.

- ^ Thoppilan et al. 2022, 섹션 5 및 6.

- ^ Hager, Ryne (June 16, 2022). "How Google's LaMDA AI works, and why it seems so much smarter than it is". Android Police. Archived from the original on June 16, 2022. Retrieved June 19, 2022.

- ^ Thoppilan et al. 2022, 섹션 6.2.

- ^ Thoppilan et al. 2022, 섹션 3 및 부록 D.