코너 검출

Corner detection| 기능 검출 |

|---|

| 에지 검출 |

| 코너 검출 |

| 블럽 검출 |

| 능선 검출 |

| 하프 변환 |

| 구조 텐서 |

| 아핀 불변 피쳐 검출 |

| 기능 설명 |

| 공간 축척 |

코너 검출은 컴퓨터 비전 시스템 내에서 특정 종류의 특징을 추출하고 이미지의 내용을 추론하기 위해 사용되는 접근법입니다.코너 검출은 모션 검출, 이미지 등록, 비디오 트래킹, 이미지 모자이크, 파노라마 스티치, 3D 재구성 및 객체 인식에 자주 사용됩니다.코너 검출은, 관심점 검출의 토픽과 겹칩니다.

형식화

모서리는 두 모서리의 교차점으로 정의할 수 있습니다.코너는 해당 지점의 로컬 근방에 두 가지 우세하고 서로 다른 에지 방향이 있는 점으로 정의할 수도 있습니다.

관심점은 잘 정의된 위치를 가지며 확실하게 검출할 수 있는 이미지 내의 점입니다.즉, 관심점은 코너일 수 있지만 예를 들어 로컬 명암 최대 또는 최소의 고립점, 선 끝 또는 곡률이 로컬 최대인 곡선상의 점일 수도 있습니다.

실제로, 대부분의 소위 코너 검출 방법은 일반적으로 관심점을 검출하며, 실제로 "코너"와 "관심점"이라는 용어는 [1]문헌을 통해 다소 상호 교환적으로 사용된다.따라서 코너만 검출할 경우에는 검출된 관심점의 국소 분석을 실시하여 어느 것이 실제 코너인지 판단해야 한다.코너를 검출하기 위해서 후처리와 함께 사용할 수 있는 에지 검출의 예로는 Kirsch 연산자와 Frei-Chen 마스킹 [2]세트가 있습니다.

"코너", "관심 포인트" 및 "특징"은 문학에서 서로 바꾸어 사용되므로 이 문제를 혼란스럽게 합니다.특히, "관심점 연산자"로 지칭할 수 있지만 "코너 검출기"로 잘못 지칭될 수 있는 여러 개의 블럽 검출기가 있다.게다가 길쭉한 물체의 존재를 포착하기 위한 능선 검출의 개념이 존재한다.

코너 검출기는 일반적으로 매우 강력하지 않으며 종종 개별 오류의 영향이 인식 작업을 지배하는 것을 방지하기 위해 대규모 중복을 도입해야 한다.

코너 검출기의 품질에 대한 한 가지 결정은 다른 조명, 변환, 회전 및 기타 변환 조건 하에서 여러 유사한 영상에서 동일한 코너를 검출할 수 있는 능력이다.

영상에서 모서리를 감지하는 간단한 방법은 상관 관계를 사용하는 것이지만, 이 방법은 계산 비용이 많이 들고 최적화되지 않습니다.자주 사용되는 대안 접근법은 Harris와 Stephens(아래)가 제안한 방법에 기초하고 있으며, 이는 다시 Moravec의 방법을 개선한 것이다.

모라벡 코너 검출 알고리즘

이것은 최초의 코너 검출 알고리즘 중 하나이며, 자기 유사성이 [3]낮은 점으로 코너를 정의합니다.이 알고리즘은, 픽셀을 중심으로 한 패치가 근처의 거의 중복되는 패치와 얼마나 유사한지를 고려하여, 이미지의 각 픽셀을 테스트하고, 코너가 존재하는지 확인합니다.유사성은 두 패치의 대응하는 픽셀 간의 제곱 차이(SSD)의 합계를 구함으로써 측정됩니다.숫자가 작을수록 유사성이 높다는 것을 나타냅니다.

픽셀이 균일한 강도 영역에 있는 경우, 근처의 패치는 비슷해 보입니다.픽셀이 가장자리에 있는 경우 가장자리에 수직인 방향의 근처 패치는 상당히 다르게 보이지만 가장자리에 평행한 방향의 근처 패치는 약간의 변화만 가져옵니다.픽셀이 모든 방향으로 변동하는 피쳐에 있는 경우 근처에 있는 패치는 모두 비슷해 보이지 않습니다.

모서리 강도는 패치와 패치의 이웃(수평, 수직 및 2개의 대각선) 사이의 최소 SSD로 정의됩니다.그 이유는 이 수치가 높으면 모든 시프트에 따른 변동은 동일하거나 크기 때문에 인근의 모든 패치가 다르게 보이기 때문입니다.

코너 강도 수치가 모든 로케이션에 대해 계산되는 경우, 한 로케이션에 대해 로컬 최대치라는 것은 해당 로케이션에 관심 있는 기능이 있음을 나타냅니다.

Moravec이 지적한 바와 같이 이 연산자의 주요 문제 중 하나는 이 연산자가 등방성이 아니라는 것입니다. 즉, 인접한 방향(수평, 수직 또는 대각선)이 아닌 가장자리가 있으면 가장 작은 SSD가 크고 가장자리가 관심 [4]포인트로 잘못 선택됩니다.

Harris & Stephens / Shi-Tomasi 코너 검출 알고리즘

Harris와 Stephens는[5] 시프트 패치를 사용하는 대신 방향에 대한 코너 점수의 차이를 직접 고려함으로써 Moravec의 코너 검출기를 개선했다. (이 코너 점수는 검출기를 설명하는 논문에서 사용되었기 때문에 종종 자기 상관이라고 불린다.)그러나 이 논문의 수학은 차이의 제곱합이 사용되고 있음을 명확히 보여준다.)

일반성을 잃지 않고 그레이스케일 2차원 이미지를 사용한다고 가정합니다.이 이미지는 I I에 의해 지정됩니다.영역 에 이미지 패치를 적용하여 (displaystyle S)만큼 이동하는 것을 검토합니다.이 두 패치(\ S의 가중치 제곱 차이(SSD) 합계는 다음과 같습니다.

u + , +)({는 Taylor 확장으로 근사할 수 있습니다.의 부분적인 파생상품으로 x와 를지정하면 과 같습니다

그러면 근사치가 생성됩니다.

매트릭스 형식으로 작성할 수 있습니다.

여기서 A는 구조 텐서이다.

즉 과에 대한 영상 의 부분 도함수의 공분산을 찾을 수 있습니다.

꺾쇠 괄호는 평균(, 합계을 나타냅니다.( ) \ u,)\ w (, ) }는 이미지 위를 슬라이드하는 창 유형을 나타냅니다.Box 필터를 사용하는 경우 응답은 이방성이지만 가우스를 사용하는 경우 응답은 등방성이 됩니다.

구석진(또는 일반 관심 지점)S{S\displaystyle}의 벡터[)y]{\displaystyle{\begin{bmatrix}x& 모든 방향으로 큰 변화에 의해;y\end{bmatrix}}}.{A\displaystyle}의 eigenvalues을 분석함으로써, 이 특성화는 다음과 같은 방법으로 표현될 수 있습니다. 특징이다. A는 관심점에 대해 두 개의 "큰" 고유값을 가져야 .고유값의 크기를 바탕으로 이 인수를 바탕으로 다음과 같은 추론을 할 수 있습니다.

- 10 \ \ { 1 } \ 0 02{\ 0 0 2{\ 0 0 0 0 、 [ {2} \ 0]의 경우,이 픽셀, y은 관심있는 특징이 없습니다.

- 10 \ style \ _ {1} \0 2 \ \ {2} 2 value value value value value value value value value value value value 、 value value value value value value value value value value

- 1\ \ { 및 2 \ \_ { 의 양의 값이 크면 코너가 발견됩니다.

Harris와 Stephens는 고유값의 정확한 계산은 제곱근의 계산이 필요하기 때문에 계산 비용이 많이 든다는 점에 주목하고 대신 다음 c c 를 제안합니다.서 는 조정 가능한 감도 파라미터입니다.

따라서 알고리즘은[6] 의 고유값 분해(\ A를 실제로 계산할 필요가 없으며 대신의 및 트레이스를 평가하여 모서리를 찾거나 일반적인 관심점을 찾는 것으로 충분합니다.

Si-Tomasi[7] 코너 검출기는 특정 가정 하에서 코너가 추적에 더 안정적이기 때문에min (1 , 2 ) { ( \ _ { , \ _ { )을 직접 한다.이 방법은 Kanade라고도 합니다.토마시 코너 검출기

의 값은 경험적으로 결정되어야 하며 0.04~0.15 범위의 문헌 값은 실현 가능한 것으로 보고되었다.

고유값의 고조파 평균에 해당하는 Noble의 코너[8] M c {\{c를 사용하면 \의 설정을 피할 수 있습니다.

양의 상수입니다

A A를 코너 위치에 대한 정밀도 매트릭스로 해석할 수 있는 코너 위치에 대한 공분산는A - 1(\입니다.

이 코너 의 일반화 분산(또는 "전체 불확실성")으로 해석될 수 있는A -1(\의 고유값 합계는 다음 방정식에 의해 Noble의 코너 M c {c}(\ M_{c와 관련이 있습니다.

Förstner 코너 검출기

경우에 따라서는 서브픽셀의 정확도로 코너의 위치를 계산해야 할 수도 있습니다.근사해를 얻기 위해 쾨르스트너[9] 알고리즘은 주어진 창에서 모서리의 모든 접선에 가장 가까운 점을 해결하며 최소 제곱 솔루션입니다.알고리즘은 이상적인 모서리의 경우 접선이 단일 점에서 교차한다는 사실에 의존합니다.

x{\(\ ')에서의 T xθ () {\ {의 방정식은 다음과 같습니다.

서I ( ) [ \ \ I ( \ { ' ) = {\ { }{y{bmatrixtop는 x {\에서 이미지의 그라데이션 벡터입니다.

의 모든 접선에 가장 가까운 점 x \x0은 다음과 같습니다.

0에서 T †(\까지의 거리는 그라데이션 크기에 따라 가중치가 부여되므로 강한 그라데이션으로 픽셀을 통과하는 접선의 중요성이 높아집니다.

0

2 ×, b 2×, R \ A \ \ { } ^ { \ 2 { 2 \ { b } \ \ { } ^ { 2 \ times } ^ { 2 \ c \ in \ { R } 。

x(\ x에 대해 미분하여 0으로 하면 이 방정식을 최소화할 수 있습니다.

, A 2 ×2 (\ 2는 구조 텐서이다.방정식이 해를 가지려면 A A가 반전 가능해야 합니다. 즉 A(\ A가 전체 순위(2위)여야 .따라서 해결책은

는 창N(\ N에서 실제 코너가 존재하는 경우에만 존재합니다.

린데버그는 정규화된 잔차를[10][11] 최소화함으로써 이 코너 위치 결정 방법에 대해 자동 스케일 선택을 수행하는 방법을 제시했다.

스케일이 너무 커요.이것에 의해, 노이즈가 많은 화상 데이터에 대해서는 보다 거친 스케일 레벨을 선택하고, 거의 이상적인 모서리 모양의 구조에 대해서는 보다 세밀한 스케일 레벨을 선택함으로써, 화상 구배를 화상 데이터내의 노이즈 레벨에 자동적으로 적응시키는 능력을 가진다.

주의:

- c는 최소 제곱 솔루션 계산의 잔차로서 볼 수 있습니다.c { c 이면 오류가 없는 것입니다.

- 이 알고리즘은 접선을 정규선으로 변경하여 원형 피쳐의 중심을 계산하도록 수정할 수 있습니다.

다중 척도 Harris 연산자

Harris 연산자의 두 번째 모멘트 매트릭스(구조 텐서라고도 함)(\ A의 계산에는 이미지 x })의 계산이 필요합니다. 도메인의 I_ 및 로컬 인접 영역에 대한 이러한 파생상품의 비선형 조합의 합계.파생상품의 계산은 보통 스케일 공간 평활의 단계를 포함하므로, Harris 연산자의 운영 정의는 두 가지 스케일 매개변수를 요구한다. (i) 이미지 파생상품의 계산 전에 평활을 위한 국소 스케일 및 (ii) 파생상품 연산자에 비선형 연산을 축적하기 위한 통합 스케일통합 이미지 기술자.

I{\ I은 원본 이미지 강도를 나타내므로L {\ L은 가우스 커널을 사용하여 컨볼루션하여 얻은I {\ I의 축척 공간 표현입니다.

로컬 스케일 t t

x { x } = \ _ { L y { _ { y } \ _ {} display 、 、 、 。 s 입니다.그런 다음 멀티스케일 두 번째 모멘트[12][13][14] 매트릭스를 다음과 같이 정의할 수 있습니다.

그런 다음고유값과 유사한 방법으로을 계산하고 다중 척도 Harris 코너 측정을 다음과 같이 정의할 수 있습니다.

로컬 스케일 t {\ t 및 스케일 s {\ s의 선택과 관련하여 이러한 스케일 는 일반적으로 s 2 \ s=\와 같은 통합 스케일 파라미터{\ {\에 의해 결합됩니다.스타일 \gamma}은 보통 간격[1,2]{\displaystyle[1,2]}.[12][13]에 그러므로 선택 우리는 금년 scale-space에서 respmulti-scale 코너 검출기를 입수할{\displaystyle지}어떤 규모 Mc({\displaystyle M_{c}(x,y, t,\gamma ^{2}t)}에서multi-scale 해리스 코너 조치를 계산할 수 있다.에 onds이미지 영역의 다양한 크기의 모서리 구조.

실제로 이 다중 스케일 코너 검출기는 종종 스케일 선택 단계로 보완되며, 스케일 정규화된 라플라시안[11][12] 연산자는 이 단계에서

축척 공간의 모든 척도에서 계산되며, 축척 조정 코너 포인트("해리스-라플라스 연산자")는 다음과 같은 지점에서 동시에 [15]계산됩니다.

- 멀티스케일 코너 의 공간 최대값 c ( , ; , 2 t,\

- 스케일 정규화된 라플라시안[11] 연산자 n r 2 ( x , ,){ _ , )의 척도에 대한 국소 최대값 또는 최소값:

레벨 곡선 곡률 접근법

코너 검출의 초기 접근법은 레벨 곡선의 곡률과 구배 크기가 동시에 [16][17]높은 점을 검출하는 것이다.이러한 점을 검출하는 미분 방법은 스케일 조정된 레벨 곡선 곡률(레벨 곡선 곡률과 3의 거듭제곱으로 상승한 그라데이션 크기의 곱)을 계산하는 것입니다.

원본 [10][11]이미지의 축척 공간 L L에서 일정 축척t(\ t에서 이 미분 표현의 양의 최대값과 음의 최소값을 검출합니다.그러나 스케일 조정된 레벨 곡선 곡률 엔티티를 단일 척도로 계산할 때 가장 큰 문제는 소음과 스케일 레벨 선택에 민감할 수 있다는 것이다.더 좋은 방법은 {\ - 정규화된 레벨 곡률 계산입니다.

7 / { \일 때, 공간과 척도에 대해 양의 최대값과 음의 최소값인 이 식의 부호 있는 축척 공간 극단을 감지하기 위해

보다 거친 [10][11][12]스케일로 현지화 오류의 증가를 처리하기 위한 보완적인 현지화 단계와 함께.이와 같이 큰 스케일 값은 큰 공간 범위의 둥근 모서리와 관련지어지고 작은 스케일 값은 작은 공간 범위의 날카로운 모서리와 관련지어집니다.이 접근방식은 (위의 "Harris-Laplace 연산자" 이전) 자동 스케일 선택 기능을 가진 최초의 코너 검출기이며, 영상[18] 영역의 대규모 변동 하에서 코너를 추적하고 건 기반 객체 [19]인식을 위한 구조 이미지 특징을 계산하기 위해 모서리에 대한 코너 응답을 일치시키는 데 사용되었다.

가우스의 라플라시안, 가우시안 차이 및 헤시안 척도-공간 관심점의 행렬식

LoG는[11][12][15] Gaussian의 Laplacian의 약자이고, DoG는[20] Gaussian의 차이를 나타내는 약자이며(DoG는 LoG의 근사치), DoH는 Hessian의 결정 [11]인자를 나타내는 약자이다.이러한 척도 불변 관심점은 모두 척도 정규화 미분 표현의 척도 공간 극단을 감지함으로써 추출된다. 즉, 해당 척도 정규화 미분 표현이 공간과 척도[11] 모두에 대해 국소 극단을 가정하는 척도 공간의 점.

서 r 은 적절한 스케일 정규화된 미분 엔티티(아래 정의)를 나타냅니다.

이러한 검출기는, BLOB 검출로 보다 완전하게 설명되고 있습니다.가우스 및 가우스 차이의 스케일 정규화된 라플라시안(Lindeberg 1994, 1998; Lowe 2004)[11][12][20]

이러한 연산자는 가장자리 근처에서도 반응할 수 있으므로 반드시 매우 선택적인 피쳐를 만들 필요는 없습니다.따라서 가우시안 검출기의 차이에 대한 코너 검출 능력을 개선하기 위해 SIFT 시스템에[20] 사용되는 특징 검출기는 추가 후 처리 단계를 사용하며, 여기서 검출 척도에서 이미지의 헤시안 고유값은 해리스 연산자와 유사한 방식으로 검사된다.고유값의 비율이 너무 높으면 로컬 영상이 너무 모서리 모양으로 간주되므로 피쳐가 거부됩니다.또한 가우스 특징 검출기의 린데버그의 라플라시안은 가장자리 [21]근처의 응답을 억제하기 위해 상보적 미분 불변량에 대한 상보적 임계값화를 구성하도록 정의할 수 있다.

헤시안 연산자의 척도 정규화 행렬식(Lindeberg 1994, 1998)[11][12]

반면, 는 잘 국소화된 이미지 기능에 대해 매우 선택적이며, 두 이미지[11][14] 방향에서 상당한 회색 수준의 변화가 있을 때만 반응하며, 이 점 및 기타 측면에서 가우스의 라플라시안보다 더 나은 관심점 검출기입니다.헤시안 행렬식은 아핀 공변 미분 표현식이며 라플라시안 연산자보다 아핀 영상 변환에서 더 나은 스케일 선택 특성을 가진다(Lindeberg 2013, 2015).[21][22]실험적으로 이는 헤시안 관심점의 결정요인이 라플라시안 관심점보다 국소 영상 변형 시 더 나은 반복성 특성을 가지며, 이는 다시 더 높은 효율성 점수 및 더 낮은 1-정밀 [21]점수 측면에서 영상 기반 매칭의 더 나은 성능으로 이어진다.

스케일 선택 특성, 아핀 변환 특성 및 이들 및 기타 스케일 공간 관심점 검출기의 실험 특성은 (Lindeberg 2013, 2015)[21][22]에서 상세하게 분석한다.

Lindeberg Hessian 특징 강도 측정에 기초한 축척 공간 관심점

f {\ f의 헤시안 H {\와 두 번째 순간 행렬(구조 )μ {\의 구조적으로 유사한 특성에 영감을 받아, 예를 들어 아핀 이미지 변형에서[13][21] 유사한 변환 특성으로 표현될 수 있다.

- f ) - ( f ) - ( \ ( ' ) = { - T } , ( ) , { -} ,

- A - A - (\ '=\,

린데버그(2013, 2015)[21][22]는 구조 텐서(두 번째 순간 매트릭스)에서 해리스 연산자와 시-토마시 연산자를 정의함에 따라 헤시안 매트릭스의 네 가지 특징 강도 측정을 관련 방식으로 정의할 것을 제안했다.구체적으로 다음과 같은 서명 없이 서명된 Hessian 특징 강도 측정을 정의했습니다.

- 부호 없는 헤시안 특징 강도 측정 I:

- 서명된 헤시안 특징 강도 측정 I:

- 부호 없는 헤시안 특징 강도 측정 II:

- 서명된 Hessian 특징 강도 척도 II:

서 trace H x + y\ \} = + H L - x y { HL =는 임의의 t(\ t에서 스케일 공간 L(\ L의 헤시안 의 트레이스 및 결정식을 나타낸다.

헤시안 [23]행렬의 고유값을 나타냅니다.

서명되지 않은 Hessian 피쳐 , rm ({,\{norm은 양의 값으로 로컬 극단에 반응하며 새들 포인트에 민감하지 않습니다. 반면 서명된 Hessian 피쳐 강도 D ~, r LDmathrm { {norm})은 {norm}입니다.새들 포인트에 음수 값으로 온에 응답합니다.서명되지 않은 Hessian 피쳐 L({{norm L은 신호의 로컬 극성에 민감하지 않습니다. 반면 서명된 Hessian 강도 D ~ 2, rmathrm {norm} 은 에 응답합니다출력의 신호로 알 수 있습니다.

린데버그(2015)[21]에서 이 네 가지 미분 엔티티는 스케일-공간 극단 검출에 기초한 국소 척도 선택과 결합되었다.

또는 스케일 링크.n나는 o r인류 나는{\displaystyle D_{2,\mathrm{규범}}나는}와 D일 2, no r인류 나는{\displaystyle{\tilde{D}}_{2,\mathrm{규범}}}게다가, 및 부호 없는 서명된 헤시 안 기능 힘 조치 D2, 보완적 D1일, no r인류 나는 을 경계화로;0{\displaystyle D_{1,\mathrm{규범}결합되었다.}> 0}。

포스터 데이터 세트에서의 스케일 변환에서의 이미지 매칭에 관한 실험에 의해, 최대 6의 스케일링 팩터에 대한 멀티 뷰 매칭과 최대 45도의 비스듬한 각도의 로컬 이미지 디스크립터를 가지는 12개의 포스터와 SIFT의 순수 이미지 디스크립터의 재구성으로부터 정의되는 방향의 변화.SURF 연산자는 이미지 피라미드에서 정의된 원본 SIFT 또는 Haar 웨이브릿에서 정의된 원본 SURF 대신 가우스 도함수 연산자(Gauss-SIFT 및 Gauss-SURF)의 관점에서 이미지 측정에 대해 신호되지 않은 헤시안 특징 강도 D1, L에 기초한 스케일 공간 관심점 검출을 보여주었다. L ( - x 2) 행렬식({displaystyle \det {norm}) = { L) {displaystyle H_mathrm {norm} L } L } L } L = L } = L = L } } = L 부호 없는 Hessian 피쳐 강도 rL({1,\{norm 부호 있는 Hessian 피쳐 강도 ~1, display { {D}, {D}}, {D}}, {1 {norm {D}}, {D {D}, {D}, {no right}, {D}, {D}}, {가우스 m L ( + _}^{=의 라플라시안보다 뛰어난 성능을 발휘합니다.L_{yy})}. 규모와 상호 보완적인 D1에 경계화, no r인류 나는 을 연관성에 결합된;0{\displaystyle D_{1,\mathrm{규범}}L>. 0}일 경우, 부호 앞에 술이 달린 군용 기능 힘 측정 D일 2, no r인류 나는{\displaystyle{\tilde{D}}_{2,\mathrm{규범}}나는}추가로 그 La.보다 성능을 향상시키기 위해 수 있도록 허락했나placia가우스 L의 n{ _

또한, 헤시안 행렬에서 정의된 이러한 모든 미분 스케일 공간 관심점 검출기는 구조 텐서(제2-모멘트 행렬)에서 정의된 해리스 및 Si-and-Tomasi 연산자에 비해 더 많은 수의 관심점을 검출하고 더 나은 일치 성능을 가능하게 하는 것으로 나타났다.

scale-space 관심 지점을 탐지하기 위한 가우시안의 Laplacian과 헤시 안의 결정기를 포함한 4헤시 안 형상 강도 대책과 다른 미분 단체의 규모를 선택 속성의 이론적 분석, Lindeberg(2013년)[22]고, 그들의 상관 변환 속성 분석으로 주어진다. 음.Lindeberg(2015)[21]의 실험 특성으로서.

아핀 적응 관심점 연산자

자동 축척 선택을 통해 멀티 스케일 Harris 연산자로부터 얻은 관심점은 공간 영역의 변환, 회전 및 균일한 재스케일링에 따라 변하지 않는다.그러나 컴퓨터 비전 시스템에 대한 입력을 구성하는 이미지는 투시 왜곡될 수 있습니다.원근법 변환에 보다 강력한 관심점 연산자를 얻기 위해, 자연적 접근법은 아핀 변환에 불변한 특징 검출기를 고안하는 것이다.실제로 아핀 불변 관심점은 평활 커널의 형상이 관심점 주위의 국소 화상 구조에 일치하도록 반복적으로 왜곡되거나 평활 커널의 형상이 회전 대칭인 채로 국소 화상 패치가 반복적으로 왜곡되는 아핀 형상 적응을 적용함으로써 얻을 수 있다.(Lindeberg 1993, 2008, Lindeberg와 Garding 1997, Mikolajzcyk와 Schmid 2004).[12][13][14][15]따라서 일반적으로 사용되는 멀티 스케일 해리스 연산자 외에도 아핀 형상 적응은 이 기사에 열거된 다른 코너 검출기뿐만 아니라 가우스 연산자의 차이인 라플라시안/헤시안-라플라스[14] 연산자에 적용할 수 있다.

Wang 및 Brady 코너 검출 알고리즘

Wang 및[24] Brady 디텍터는 이미지를 표면으로 간주하고 이미지 가장자리를 따라 곡률이 큰 곳을 찾습니다.즉, 알고리즘은 가장자리가 빠르게 방향을 바꾸는 장소를 찾습니다.코너 점수 C는 다음과 같이 부여됩니다.

서 t은(는) 구배에 수직인 단위 이고 cc는 검출기의 에지 공포도를 결정합니다.저자들은 또한 소음을 줄이기 위해 평활화(가우스어 권장)가 필요하다는 점에 주목한다.

평활화는 코너의 변위도 유발하므로 저자는 90도 코너의 변위에 대한 식을 도출하여 이를 검출된 코너에 보정계수로 적용한다.

SUSAN 코너 디텍터

SUSAN은[25] 가장 작은 단가분절 동화핵을 나타내는 약어이다.이 방법은 1994년 영국 특허의 대상이며,[26] 더 이상 유효하지 않습니다.

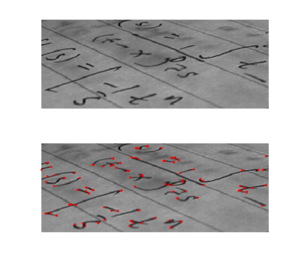

특징 검출을 위해 SUSAN은 테스트할 픽셀(핵) 위에 원형 마스크를 배치합니다.마스크의 영역은 {\ M이며, 이 마스크의 픽셀은 m M M으로 됩니다. 핵은 m 0})입니다 픽셀은 비교 기능을 사용하여 핵과 비교됩니다.

서 t{\t}는 밝기 [27]차이 I {\ I}는 픽셀의 밝기이며 지수의 세기는 경험적으로 결정됩니다.이 함수는 평활 탑 햇 또는 직사각형 함수의 외관을 가지고 있습니다.SUSAN의 영역은 다음과 같습니다.

cc가 직사각형 함수인 n은 마스크 내의 핵의 tt 에 있는 픽셀 수입니다.SUSAN 연산자의 응답은 다음과 같습니다.

서 gg는 '최소 임계값'으로 명명됩니다.즉, SUSAN 연산자는 영역이 충분히 작을 경우에만 양의 점수를 가집니다.로컬에서 가장 작은 SUSAN은 비최대 억제를 사용하여 찾을 수 있으며, 이것이 완전한 SUSAN 연산자입니다.

tt는 단일값 세그먼트의 일부로 간주되기 전에 핵과 얼마나 유사한 점이 있어야 하는지를 결정합니다. g 값은 단일값 세그먼트의 최소 크기를 결정합니다. g가 충분히 크면 엣지 디텍터가 됩니다.

코너 검출에는, 한층 더 2개의 스텝이 사용됩니다.먼저 SUSAN의 중심을 찾습니다.적당한 모서리는 중심핵에서 멀리 떨어진 곳에 있을 것이다.두 번째 단계에서는 중심에서 마스크 가장자리에 이르는 선상의 모든 점이 SUSAN에 있어야 합니다.

Trajkovic and Hedley 코너 검출기

있는 방법을 SUSAN과 비슷한에서, 이 detector[28]지 말지에 직접적인 화소에 따라 패치 근처 픽셀을 관찰함으로써self-similar 있다. P{P\displaystyle}c→에 중점을 둔 동그라미에 \in P}은 포인트 c({\displaystyle{\vec{c}}}의 픽셀, 및 p→ P{\displaystyle{\vec{p}∈}는 것으로 생각된다 테스트합니다. {)displaystyle을 클릭합니다. { } is the {\ { style } } to to to to to to to to the the to the the → {p to to to to to to to

응답 함수는 다음과 같이 정의됩니다.

이것은 중심 픽셀이 직경을 따라 두 개의 가까운 픽셀과 유사한 방향이 없을 때 커집니다.{\ P는 분산된 원(Breesenham 원)이므로 중간 직경에 보간법을 사용하여 등방성 응답을 제공합니다.어떤 도min의 상한을 부여하므로 수평방향과 수직방향은먼저 하여 c\c의 한 계산을 진행할 가치가 있는지 확인합니다.

AST 기반 피쳐 디텍터

AST는 가속 세그먼트 테스트의 약자입니다.이 테스트는 SUSAN 코너 기준의 완화된 버전입니다.원형 디스크를 평가하는 대신 후보 지점 주변의 rr의 브레센햄 원 내의 픽셀만 고려됩니다.n n개의 연속된 픽셀이 모두 nucle보다t{ t 이상 밝거나 보다 t{ t 이상 어두운 nucle 아래의 픽셀은 특징으로 간주됩니다.이 테스트는 매우 안정적인 [29]기능을 생성하는 것으로 보고되었습니다.픽셀을 테스트하는 순서를 선택하는 것은 이른바 스무 가지 질문의 문제입니다.이 문제에 대한 짧은 결정 트리를 구축하면 가장 효율적인 기능 검출기를 사용할 수 있습니다.

AST에 기반한 첫 번째 코너 감지 알고리즘은 FAST(가속 세그먼트 [29]테스트의 특징)입니다.rr은 원칙적으로 임의의 값을 취할 수 FAST는 3(둘레 16픽셀의 원에 해당)의 값만 사용하며 테스트 결과 nn이 9일 때 의 결과를 얻을 수 있습니다.이 값 n은 에지가 검출되지 않는 가장 낮은 값입니다.픽셀이 테스트되는 순서는 트레이닝 이미지 세트의 ID3 알고리즘에 의해 결정됩니다.검출기의 이름은 Trajkovic과 Hedley의 검출기를 설명하는 논문의 이름과 다소 유사하다.

검출기 자동 합성

트루히요와 올라그는[30] 유전자 프로그래밍을 이용해 관심 지점을 검출할 수 있는 영상 연산자를 자동으로 합성하는 방법을 도입했다.터미널 및 기능 세트에는 이전에 제안된 많은 인공 설계에서 공통적인 원시 연산이 포함되어 있습니다.적합성은 반복성 비율을 통해 각 운영자의 안정성을 측정하고 이미지 평면에 감지된 점을 균일하게 분산시킵니다.진화한 연산자의 성능은 점진적으로 변환된 영상의 훈련 및 테스트 시퀀스를 사용하여 실험적으로 확인되었습니다.따라서 제안된 GP 알고리즘은 관심점 검출 문제에 대해 인간 경쟁력이 있는 것으로 간주된다.

시공간 관심점 검출기

Harris 연산자는 Laptev와 Lindeberg에 [31]의해 시공간으로 확장되었습니다.μ \mu는 다음과 같이 정의된 시공간 2차 모멘트 매트릭스를 나타냅니다.

그런 다음 k<1/ \ k < 1 / 27 \ k < / 의 적절한 선택에 대해 다음과 같은 시공간 해리스 측정의 시공간 극단에서 시공간 관심점을 검출한다.

헤시안 연산자의 행렬식은 빌럼스 외 연구진과 린데버그에 [33]의해 결합 시공간으로 확장되어 다음과 같은 척도 정규화 미분식으로 이어졌다.

Willems et [32]al의 연구에서는 § { _}= § { _ }=에 대응하는 보다 간단한 표현을 사용했다.Lindeberg,[33]에서 γ의 5/4{\displaystyle \gamma_{s}=5/4}과γ τ)5/4{\displaystyle \gamma_{\tau}=5/4}{그 의미에서 나은 수준 선택 속성은 선택한 규모 수준 공간 범위 s와 시공간 가우스 blob를 통해 입수한)그거 0{\displaystyle s=s_을 의미하는 것이 보여졌다.0}} 시간 범위 0 { \ = \ _ { } 은 미분식의 시공간 범위 및 시간 지속 시간과 완벽하게 일치하며, 축척 선택은 시공간 극단을 감지하여 수행됩니다.

Laplacian 연산자는 [33]Lindeberg에 의해 시공간 비디오 데이터로 확장되어 다음과 같은 2개의 시공간 연산자로 이어졌다. 이 두 연산자는 또한 LGN에서 비시공간 뉴런 대 시공간 뉴런 수용장 모델을 구성한다.

첫 번째 연산자의 경우 공간 범위와 시간적 듀라티를 반영하는 시공간적 스케일에서 시공간적 스케일보다 최대값을 가정하려면 스케일 선택 속성에서 {\ } 를 사용해야 합니다.가우스 블럽의 시작입니다.두 번째 연산자의 경우 공간 범위와 시간 경색을 반영하는 시공간적 스케일에서 시공간적 스케일보다 최대값을 가정하려면 스케일 선택 속성에서 \ }=3/4및 δ = 3 \displaystyle } =3/4을 사용해야 합니다.점멸하는 가우스 블롭의 발생.

시공간 관심점 검출기의 색 확장은 에버츠 [34]등에 의해 조사되었다.

참고 문헌

- ^ Andrew Willis and Yunfeng Sui (2009). "An Algebraic Model for fast Corner Detection". 2009 IEEE 12th International Conference on Computer Vision. IEEE. pp. 2296–2302. doi:10.1109/ICCV.2009.5459443. ISBN 978-1-4244-4420-5.

- ^ 샤피로, 린다, 조지 C.Stockman(2001년).컴퓨터 비전, 페이지 257. 프렌티스 북스, 어퍼 새들 리버ISBN 0-13-030796-3.

- ^ H. Moravec (1980). "Obstacle Avoidance and Navigation in the Real World by a Seeing Robot Rover". Tech Report CMU-RI-TR-3 Carnegie-Mellon University, Robotics Institute.

- ^ Seeing Robot Rover, Hans Moravec, 1980년 3월 스탠퍼드 대학교 컴퓨터과학과(박사 논문)에 의한 현실 세계의 장애물 회피 및 내비게이션

- ^ C. Harris and M. Stephens (1988). "A combined corner and edge detector" (PDF). Proceedings of the 4th Alvey Vision Conference. pp. 147–151.

- ^ Javier Sánchez, Nelson Monzón and Agustín Salgado (2018). "An Analysis and Implementation of the Harris Corner Detector" (PDF). Image Processing on Line. 8: 305–328. doi:10.5201/ipol.2018.229. Archived from the original on 2018-10-03.

- ^ J. Shi and C. Tomasi (June 1994). "Good Features to Track". 9th IEEE Conference on Computer Vision and Pattern Recognition. Springer. pp. 593–600. CiteSeerX 10.1.1.36.2669. doi:10.1109/CVPR.1994.323794.

C. Tomasi and T. Kanade (1991). Detection and Tracking of Point Features (Technical report). School of Computer Science, Carnegie Mellon University. CiteSeerX 10.1.1.45.5770. CMU-CS-91-132. - ^ A. Noble (1989). Descriptions of Image Surfaces (Ph.D.). Department of Engineering Science, Oxford University. p. 45.

- ^ Förstner, W; Gülch (1987). "A Fast Operator for Detection and Precise Location of Distinct Points, Corners and Centres of Circular Features" (PDF). ISPRS.

- ^ a b c T. Lindeberg (1994). "Junction detection with automatic selection of detection scales and localization scales". Proc. 1st International Conference on Image Processing. Vol. I. Austin, Texas. pp. 924–928.

- ^ a b c d e f g h i j k Tony Lindeberg (1998). "Feature detection with automatic scale selection". International Journal of Computer Vision. Vol. 30, no. 2. pp. 77–116.

- ^ a b c d e f g h T. Lindeberg (1994). Scale-Space Theory in Computer Vision. Springer. ISBN 978-0-7923-9418-1.

- ^ a b c d T. 린데버그와 J. 가딩은 "국소 2-D 구조의 아핀 왜곡으로부터 3차원 깊이 신호를 추정할 때 형상 적응 평활"을 수행했다.이미지 및 비전 컴퓨팅 15(6): 페이지 415-434, 1997.

- ^ a b c d T. Lindeberg (2008). "Scale-Space". In Benjamin Wah (ed.). Wiley Encyclopedia of Computer Science and Engineering. Vol. IV. John Wiley and Sons. pp. 2495–2504. doi:10.1002/9780470050118.ecse609. ISBN 978-0-470-05011-8.

- ^ a b c K. Mikolajczyk, K. and C. Schmid (2004). "Scale and affine invariant interest point detectors" (PDF). International Journal of Computer Vision. 60 (1): 63–86. doi:10.1023/B:VISI.0000027790.02288.f2.

- ^ L. Kitchen and A. Rosenfeld (1982). "Gray-level corner detection". Pattern Recognition Letters. Vol. 1, no. 2. pp. 95–102.

- ^ J. J. Koenderink and W. Richards (1988). "Two-dimensional curvature operators". Journal of the Optical Society of America A. Vol. 5, no. 7. pp. 1136–1141.

- ^ L. Bretzner and T. Lindeberg (1998). "Feature tracking with automatic selection of spatial scales". Computer Vision and Image Understanding. Vol. 71. pp. 385–392.

- ^ T. Lindeberg and M.-X. Li (1997). "Segmentation and classification of edges using minimum description length approximation and complementary junction cues". Computer Vision and Image Understanding. Vol. 67, no. 1. pp. 88–98.

- ^ a b c D. Lowe (2004). "Distinctive Image Features from Scale-Invariant Keypoints". International Journal of Computer Vision. 60 (2): 91. CiteSeerX 10.1.1.73.2924. doi:10.1023/B:VISI.0000029664.99615.94.

- ^ a b c d e f g h T. 린데버그, "일반화된 축척 공간의 관심점을 이용한 이미지 매칭", 수학 이미징 및 비전 저널, 52권, 1번, 3-36쪽, 2015년.

- ^ a b c d T. 린데버그 "일반화된 스케일 공간 관심점 검출기의 척도 선택 특성", 수학 영상 및 비전 저널, 제46권, 제2호, 177-210페이지, 2013.

- ^ Lindeberg, T. (1998). "Edge detection and ridge detection with automatic scale selection". International Journal of Computer Vision. 30 (2): 117–154. doi:10.1023/A:1008097225773.

- ^ H. Wang and M. Brady (1995). "Real-time corner detection algorithm for motion estimation". Image and Vision Computing. 13 (9): 695–703. doi:10.1016/0262-8856(95)98864-P.

- ^ S. M. Smith and J. M. Brady (May 1997). "SUSAN – a new approach to low level image processing". International Journal of Computer Vision. 23 (1): 45–78. doi:10.1023/A:1007963824710.

S. M. Smith 및 J. M. Brady(1997년 1월), "무인 차량의 안내를 위해 이미지를 디지털로 처리하는 방법"영국 특허 2272285, 소유자:영국 국방부 장관 - ^ GB 특허 2272285, Smith, Stephen Mark, 1994-05-11, 발행 1994-05-11, Secr Defense에 할당됨

- ^ "The SUSAN Edge Detector in Detail".

- ^ M. Trajkovic and M. Hedley (1998). "Fast corner detection". Image and Vision Computing. 16 (2): 75–87. doi:10.1016/S0262-8856(97)00056-5.

- ^ a b E. Rosten and T. Drummond (May 2006). "Machine learning for high-speed corner detection". European Conference on Computer Vision.

- ^ Leonardo Trujillo and Gustavo Olague (2008). "Automated design of image operators that detect interest points" (PDF). Evolutionary Computation. 16 (4): 483–507. doi:10.1162/evco.2008.16.4.483. PMID 19053496. Archived from the original (PDF) on 2011-07-17.

- ^ Ivan Laptev and Tony Lindeberg (2003). "Space-time interest points". International Conference on Computer Vision. IEEE. pp. 432–439.

- ^ a b Geert Willems, Tinne Tuytelaars and Luc van Gool (2008). "An efficient dense and scale-invariant spatiotemporal-temporal interest point detector". European Conference on Computer Vision. Springer Lecture Notes in Computer Science. Vol. 5303. pp. 650–663. doi:10.1007/978-3-540-88688-4_48.

- ^ a b c Tony Lindeberg (2018). "Spatio-temporal scale selection in video data". Journal of Mathematical Imaging and Vision. Vol. 60, no. 4. pp. 525–562. doi:10.1007/s10851-017-0766-9.

- ^ I. Everts, J. van Gemert and T. Gevers (2014). "Evaluation of color spatio-temporal interest points for human action recognition". IEEE Transactions on Image Processing. Vol. 23, no. 4. pp. 1569–1589. doi:10.1109/TIP.2014.2302677.

레퍼런스 실장

이 섹션에서는 위에서 설명한 일부 디텍터의 참조 구현에 대한 외부 링크를 제공합니다.이러한 기준 구현은 검출기가 최초로 기술된 논문의 저자에 의해 제공된다.여기에는 이 기능을 설명하는 문서에 존재하지 않거나 명시적이지 않은 세부 정보가 포함될 수 있습니다.

- DoG 검출(SIFT 시스템의 일부), Windows 및 x86 Linux 실행 파일

- Harris-Laplace, 정적 Linux 실행 파일.또한 포함된 모든 검출기에 대한 DoG 및 LoG 검출기 및 아핀 적응이 포함됩니다.

- FAST 디텍터, C, C++, MATLAB 소스 코드 및 다양한 운영 체제 및 아키텍처용 실행 파일.

- lip-vireo, [LoG, DoG, Harris-Laplacian, Hessian 및 Hessian-Laplacian], [SIFT, 플립 불변 SIFT, PCA-SIFT, Steable Filters, SIN] 실행 파일.

- SUSAN Low Level Image Processing(SUSAN Low Level Image Processing), C 소스 코드.

- Harris Corner Detector 온라인 실장 - IPOL

「 」를 참조해 주세요.

외부 링크

- Lindeberg, Tony (2001) [1994], "Corner detection", Encyclopedia of Mathematics, EMS Press

- Brostow, "코너 검출 - UCL 컴퓨터 사이언스"

이미지 패치를 적용하여 (

이미지 패치를 적용하여 (

Taylor

Taylor

대한 영상

대한 영상

조정 가능한 감도 파라미터입니다.

조정 가능한 감도 파라미터입니다.

사용하면

사용하면

방정식은 다음과 같습니다.

방정식은 다음과 같습니다.

x

x

모든 접선에 가장 가까운 점 x

모든 접선에 가장 가까운 점 x

거리는 그라데이션 크기에 따라 가중치가 부여되므로 강한 그라데이션으로 픽셀을 통과하는 접선의 중요성이 높아집니다.

거리는 그라데이션 크기에 따라 가중치가 부여되므로 강한 그라데이션으로 픽셀을 통과하는 접선의 중요성이 높아집니다.

가우스 커널을 사용하여 컨볼루션하여 얻은

가우스 커널을 사용하여 컨볼루션하여 얻은

의해 결합됩니다.스타일 \gamma}은 보통 간격[1,2]{\displaystyle[1,2]}.[12][13]에 그러므로 선택 우리는 금년 scale-space에서 respmulti-scale 코너 검출기를 입수할{\displaystyle지}어떤 규모 Mc({\displaystyle M_{c}(x,y, t,\gamma ^{2}t)}에서multi-scale 해리스 코너 조치를 계산할 수 있다.에 onds이미지 영역의 다양한 크기의 모서리 구조.

의해 결합됩니다.스타일 \gamma}은 보통 간격[1,2]{\displaystyle[1,2]}.[12][13]에 그러므로 선택 우리는 금년 scale-space에서 respmulti-scale 코너 검출기를 입수할{\displaystyle지}어떤 규모 Mc({\displaystyle M_{c}(x,y, t,\gamma ^{2}t)}에서multi-scale 해리스 코너 조치를 계산할 수 있다.에 onds이미지 영역의 다양한 크기의 모서리 구조.

때, 공간과 척도에 대해 양의 최대값과 음의 최소값인 이 식의 부호 있는 축척 공간 극단을 감지하기 위해

때, 공간과 척도에 대해 양의 최대값과 음의 최소값인 이 식의 부호 있는 축척 공간 극단을 감지하기 위해

적절한 스케일 정규화된 미분 엔티티(아래 정의)를 나타냅니다.

적절한 스케일 정규화된 미분 엔티티(아래 정의)를 나타냅니다.

헤시안

헤시안  두 번째 순간 행렬(구조

두 번째 순간 행렬(구조

임의의

임의의  트레이스 및 결정식을 나타낸다.

트레이스 및 결정식을 나타낸다.

양의 값으로 로컬 극단에 반응하며 새들 포인트에 민감하지 않습니다. 반면 서명된 Hessian 피쳐 강도

양의 값으로 로컬 극단에 반응하며 새들 포인트에 민감하지 않습니다. 반면 서명된 Hessian 피쳐 강도

분산된 원(

분산된 원(

대응하는 보다 간단한 표현을 사용했다.Lindeberg,[33]에서 γ의 5/4{\displaystyle \gamma_{s}=5/4}과γ τ)5/4{\displaystyle \gamma_{\tau}=5/4}{그 의미에서 나은 수준 선택 속성은 선택한 규모 수준 공간 범위 s와 시공간 가우스 blob를 통해 입수한)그거 0{\displaystyle s=s_을 의미하는 것이 보여졌다.0}}

대응하는 보다 간단한 표현을 사용했다.Lindeberg,[33]에서 γ의 5/4{\displaystyle \gamma_{s}=5/4}과γ τ)5/4{\displaystyle \gamma_{\tau}=5/4}{그 의미에서 나은 수준 선택 속성은 선택한 규모 수준 공간 범위 s와 시공간 가우스 blob를 통해 입수한)그거 0{\displaystyle s=s_을 의미하는 것이 보여졌다.0}}