오브젝트 공동 세그멘테이션

Object co-segmentation

컴퓨터 시각에서 객체 공동 분할은 여러 이미지 또는 비디오 [2][3]프레임에서 의미론적으로 유사한 객체를 공동으로 분할하는 것으로 정의되는 이미지 분할의 특별한 경우입니다.

과제들

노이즈가 많은 이미지 또는 비디오 프레임 컬렉션에서 대상/객체의 분할 마스크를 추출하는 것은 종종 어렵습니다. 이 경우 분할과 함께 객체 검출이 수반됩니다.노이즈가 많은 수집은 대상/표적이 일련의 화상에 산발적으로 존재하거나 대상/표적이 관심 비디오 전체에서 간헐적으로 사라지는 것을 의미합니다.초기[4][5] 방법에는 일반적으로 객체 제안과 같은 중간 수준의 표현이 포함됩니다.

동적 마르코프 네트워크 기반 방식

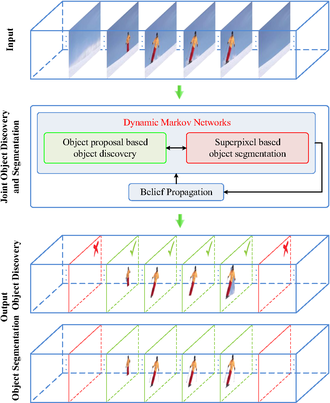

결합된 동적 마르코프 네트워크를 기반으로 한 공동 객체 발견 및 공동 세분화 방법이 [1]최근 제안되었으며, 이는 무관하거나 시끄러운 비디오 프레임에 대한 견고성의 상당한 향상을 주장한다.

입력 비디오 전체에 걸쳐 대상 객체의 일관된 존재를 편리하게 가정하는 이전의 노력과는 달리, 이 결합된 이중 동적 마르코프 네트워크 기반 알고리즘은 믿음 전파를 통해 공동으로 업데이트된 두 개의 각각의 마르코프 네트워크를 사용하여 동시에 검출 및 분할 태스크를 수행한다.

구체적으로는 분할을 담당하는 마르코프 네트워크는 슈퍼픽셀로 초기화되어 객체 검출 태스크를 담당하는 마르코프 네트워크에 대한 정보를 제공한다.반대로 검출을 담당하는 마르코프 네트워크는 시공간 분할관을 포함한 입력으로 객체 제안 그래프를 구축한다.

그래프 절단 기반 방법

그래프 컷 최적화는 컴퓨터 비전, 특히 초기 이미지 분할 애플리케이션에서 널리 사용되는 도구입니다.규칙적인 그래프 컷의 연장선상에서, 다단계 하이퍼 그래프 컷은 전형적인 쌍별 상관관계를 넘어 비디오 그룹 사이의 보다 복잡한 고차 대응관계를 설명하기 위해 제안된다[6].

이러한 하이퍼그래프 확장을 통해 낮은 수준의 외관, 기울기, 일관성 있는 움직임 및 객체 영역과 같은 높은 수준의 특징을 포함한 대응의 여러 가지 양식이 하이퍼그래프 계산에 심리스하게 통합될 수 있다.또한, 공존 기반 접근법에 대한 핵심 이점으로서 하이퍼그래프는 라플라시안 행렬의 고유값 분해에 의해 편리하게 계산된 하이퍼게이지 가중치와 함께 정점 사이에 더 복잡한 대응 관계를 암묵적으로 유지한다.

CNN/LSTM 기반 방식

동작 국재 어플리케이션에서는 오브젝트 코세그먼테이션도 세그먼트-튜브 시공간 [7]검출기로서 구현된다.Le 등은 튜브렛(경계 상자의 시퀀스)을 사용한 최근 시공간 작용 국재화 노력에 영감을 받아 프레임당 분할 마스크 시퀀스로 구성된 새로운 시공간 작용 국재화 검출기 Segment-tube를 제시한다.이 세그먼트 튜브 검출기는 시뮬레이션되지 않은 비디오에서 선행/후속 간섭 작용이 존재하는 경우 각 작용 범주의 시작/종료 프레임을 일시적으로 특정할 수 있다.동시에 세그먼트 튜브 디텍터는 경계 상자 대신 프레임별 분할 마스크를 생성하여 튜브렛보다 공간 정확도가 우수합니다.이는 시간적 작용 국부화와 공간적 작용 세분화 사이에서 번갈아 반복 최적화를 통해 달성된다.

제안된 세그먼트 튜브 검출기는 오른쪽 흐름도에 설명되어 있다.샘플 입력은 쌍 피겨 스케이팅 비디오의 모든 프레임을 포함하는 시뮬레이션되지 않은 비디오이며, 이러한 프레임의 일부만 관련 카테고리(예: DeathSpirals)에 속합니다.개개의 프레임에 대해 salency 베이스의 화상 분할에 의해 초기화된 이 방법은 우선 캐스케이드된 3D CNN 및 LSTM에 의해 일시적 동작 국재화 스텝을 실행하고, 조잡하고 미세화 전략으로 타깃 동작의 시작 프레임과 종료 프레임을 핀포인트한다.이어서 세그먼트-튜브 검출기는 시간 작용 국재화 스텝에 의해 식별된 관련 프레임에 초점을 맞추어 그래프 컷으로 프레임 단위의 공간 분할을 조정한다.최적화는 반복적인 방식으로 시간 동작 국부화와 공간 동작 분할을 번갈아 수행합니다.실제 컨버전스 시에, 최종 시공간 액션의 국소화 결과는, 정확한 시작/종료 프레임을 가지는 프레임 단위의 세그먼트화 마스크(플로차트의 하단 행)의 시퀀스의 형식으로 취득된다.

「 」를 참조해 주세요.

레퍼런스

- ^ a b c d Liu, Ziyi; Wang, Le; Hua, Gang; Zhang, Qilin; Niu, Zhenxing; Wu, Ying; Zheng, Nanning (2018). "Joint Video Object Discovery and Segmentation by Coupled Dynamic Markov Networks" (PDF). IEEE Transactions on Image Processing. 27 (12): 5840–5853. Bibcode:2018ITIP...27.5840L. doi:10.1109/tip.2018.2859622. ISSN 1057-7149. PMID 30059300. S2CID 51867241.

- ^ Vicente, Sara; Rother, Carsten; Kolmogorov, Vladimir (2011). Object cosegmentation. IEEE. doi:10.1109/cvpr.2011.5995530. ISBN 978-1-4577-0394-2.

- ^ Chen, Ding-Jie; Chen, Hwann-Tzong; Chang, Long-Wen (2012). Video object cosegmentation. New York, New York, USA: ACM Press. doi:10.1145/2393347.2396317. ISBN 978-1-4503-1089-5.

- ^ Lee, Yong Jae; Kim, Jaechul; Grauman, Kristen (2011). Key-segments for video object segmentation. IEEE. doi:10.1109/iccv.2011.6126471. ISBN 978-1-4577-1102-2.

- ^ Ma, Tianyang; Latecki, Longin Jan. Maximum weight cliques with mutex constraints for video object segmentation. IEEE CVPR 2012. doi:10.1109/CVPR.2012.6247735.

- ^ Wang, Le; Lv, Xin; Zhang, Qilin; Niu, Zhenxing; Zheng, Nanning; Hua, Gang (2020). "Object Cosegmentation in Noisy Videos with Multilevel Hypergraph" (PDF). IEEE Transactions on Multimedia. IEEE. 23: 1. doi:10.1109/tmm.2020.2995266. ISSN 1520-9210. S2CID 219410031.

- ^ a b c 왕, 르, Duan, Xuhuan, 장쯔이 치린;뉴, 전싱. 후아, 갱, 정화, 특히(2018-05-22)."Segment-Tube:Spatio-Temporal 관리 지역화 Untrimmed 비디오에도 Per-Frame 분할과"(PDF).있는 센서다.MDPI했다. 18(5):1657년.Bibcode:2018Senso..18.1657W. doi:10.3390/s18051657.ISSN 1424-8220.PMC5982167.PMID 29789447.재료는 창조적 공용 귀인 4.0국제 라이센스 하에 가능하다 이 원본에서 복사되었다.